生活是不确定性的。

Let's face it - Life is uncertain 周报这个题材是学的https://www.pseudoyu.com/posts 的博客风格,但人家能保持每两周写一篇,我还是算了吧:)...

随笔与游记 · 记录生活里的光与尘

Let's face it - Life is uncertain 周报这个题材是学的https://www.pseudoyu.com/posts 的博客风格,但人家能保持每两周写一篇,我还是算了吧:)...

墨尔本RMIT门口。 #Writing

前言 2024年在微博上给自己立了一个OKR是「重新成为一个有趣的人」。这个「有趣」的来源,其实是翻看以前的微博时,18-19、20-21年这两段时间的整个人状态是个人最喜欢的。...

Lost in Tokyo 04> 纪念2025.01.01 - 01.05 的五天四夜东京之旅。 很遗憾一次性并不能全部写完。 Day4: 浅草寺与庙会 第四天天气又恢复了晴朗。 这一天主要是在浅草寺和逛庙会。 雷门,全是人。...

Lost in Tokyo 03> 纪念2025.01.01 - 01.05 的五天四夜东京之旅。 很遗憾一次性并不能全部写完。 Day 3: 科学与艺术 到日本的前两天天气都很好,以至于我们有一种“沿海城市可能每天都是蓝天白云吧”的错觉。第三天就给了当头一棒,早上起床拉开窗帘就发现是个阴天。...

突如其来的道别> 原文发表在微博上。2024年6月16日从北京举家搬迁回了成都,仅仅三天后又到北京出差。在晚上下班后,突发奇想扫了一辆美团单车,在北京夏夜的凉风中骑了一个多小时,回酒店后有感而发,用手机打下了这段话。 晚上回到酒店闲着无事,下楼抽根烟,然后发现我骑到酒店的美团单车还停在原地,心血来潮又骑上了车。...

Lost in Tkoyo 02> 纪念2025.01.01 - 01.05 的五天四夜东京之旅。 很遗憾一次性并不能全部写完。 迷失东京02:御台场纪念日 国内一般把**お台場**翻译成「御台场」,主要是受到数码兽大冒险第一部(digimon adventure...

Lost in Tkoyo 01> 纪念2025.01.01 - 01.05 的五天四夜东京之旅。 很遗憾一次性并不能全部写完。 关于这次旅行...

这是一篇久违了四年的博客。 这几年很少对外表达,包括博客、微博、朋友圈。一方面自我感觉没什么实质上的收获和可以对外分享的东西,另一方面大概也是对自己的生活并不是特别满意。另外,在自建的博客上发表一篇完整的文章苏需要的工序还蛮多的,这种形式感会不自觉地对内容的规整性有要求,所以往往刚起了一个念头就半途而废。...

男,四川土著,~~帅且可爱~~。 不吐槽会死星人。理性,毒舌,孤僻,宅。 会弹琴,常听J-Rock, J-Pop, Folks, Original Soundtrack。喜欢 いきものがかり (生物股长), Aimyon , Mr.Children , 宋冬野, 陈致逸 。...

我是HeYan,男,四川土著,~~帅且可爱~~,🌈。理性,INTP,热爱科学,并且有点宅。会弹琴,常听J-Rock, J-Pop, Folks, Original Soundtrack。喜欢 いきものがかり (生物股长),Aimyon ,陈致逸 。现在常住在北京。...

昨天开始正式步入了『二十岁』这个区间的最后一个年头,但是特别忙,和京东来的人开会,去瓜子做贷后检查,然后五点回公司又帮同事check代码,晚上还开了个data的汇报会,回家躺沙发上居然就这么直接睡着了,想写点感想也没机会。...

1. 距离春节五月有余,终于又一次离开北京前往上海,为aimyon上海演唱会以及平安京三人组首次当面开黑。 上一次正经听演唱会是15年北京五棵松的Rie Fu,...

FRM终于出坑了。 从毕业开始断断续续看书、考试,每次都是没复习完就匆匆上考场被虐四个小时再下来,以后再也不像这样了…… 接下来是CFA和CPA。 以及还有一堆网课要刷呢。 #Writing/2019 #Writing/杂谈

上周去参加了猫眼学院的公开课第一期,主讲是关雅荻。 作为一个从幼儿园到大学都生活在女生远多于男生(譬如文科班,财大,金融,etc.)的环境中的人,坐在这次公开课的观众群体第二排时的确有一些「熟稔」的感觉,氛围与气场让我更舒适和游刃有余,心态上的轻松感非常明显。...

最近写博客的频率骤降,快要变成每月一次的节奏。 最近忙得兵荒马乱,昨天一边洗澡一边想,除了“兵荒马乱”这个已经被我用滥的词之外还有什么词语可以形容忙得一团糟的生活,答案是还真想不起来。 哎,毕竟不看小说好多年。...

本文发表于2014年5月7日 mini2里只有一个游戏,就是flappy bird。 我不是那么无趣的一个人,这类单调枯燥的游戏一向是没啥耐心玩下去的。...

本文发表于2012年9月3日...

昨天的这个时候,大年三十,我还在北京海淀知春路中航广场的字节跳动矮楼二楼为头条的春节活动值班。大概一点过,忙得差不多,好不容易叫到一辆神州,趁师傅从二环开过来的空隙下楼抽了根烟。 大年三十的北京其实很冷清,看不到烟火,远处的高楼大概零星点亮了几户人家,然后就是死一般的寂静,烟头的火星在零下十度的寒风中摇曳。...

有一个大学玩得比较好的同学的小微信群,最近的讨论话题都围绕着买房、跳槽、生孩子。 很多事情做决定时总是有一大堆现实因素扯着你往地上拽,比如从SMU回成都的朋友L会因为男朋友和家庭父母原因而难以去自己想去的城市。...

本文发表于2014–09-01 下班之前得知上周工作小组倒数TOP1,心里居然觉得“哦”就这么过去了。反正也是不喜欢的工作,你叫我怎么提得起兴趣去做。...

自从毕业以后,我飞的次数其实也不算少,但是还是常年恐飞,所以试过很多在飞机上缓解焦虑的方法: 听歌:通常一首歌4分钟,国内航线听30首歌就足够。不功不过。 看电影:不是一个好方法。其中最糟糕的体验是看了釜山行(封闭空间大逃杀)和星际穿越(涉及飞行器爆炸),整个人都不好了。搞不懂那些在途中看空中浩劫的人怎么想的……...

本文发表于2012年9月3日 在ipad上下载了《ONE PIECE》漫画,准备一次性追完。虽说是三大民工漫之首,但质量的确不错。其实是想让自己爱上了海贼王之后又能在“喜欢”这一范围内新增一系列海贼相关的周边,不追点漫画心里不是很自在的感觉。...

#Courses/MITx/6.431 1. Motivation Let's face it - Life is uncertain 2. Lecture 1 overview and slides 3. Sample space 5. Sample space examples 6. Exercise: Tree...

**Lecture 11. Derived distributions 导出分布** #Courses/MITx/6.431 1. Lecture 11 overview and slides 讲义概览 This lecture develops a method for finding the...

**Lecture 12. Sums of independent r.v.'s; Covariance and correlation 独立随机变量和,协方差与相关性** #Courses/MITx/6.431 1. Lecture 12 overview and slides This lecture...

**Lecture 13. Conditional expectation and variance revisited; Sum of a random number of independent r.v.'s 条件期望与条件方差复习;随机数个独立随机变量和** #Courses/MITx/6.431 1....

**Lecture 14. Introduction to Bayesian inference 贝叶斯统计推断导论** #Courses/MITx/6.431 1. Lecture 14 overview and slides In this lecture, we start by discussing the...

**Lecture 15. Linear models with normal noise 正态噪声的线性模型** #Courses/MITx/6.431 1. Lecture 15 overview and slides In this lecture we focus on an important...

**Lecture 16. Least mean squares (LMS) estimation 最小均方估计** #Courses/MITx/6.431 1. Lecture 16 overview and slides In this lecture we focus on the conditional...

**Lecture 19. The Central Limit Theorem (CLT) 中心极限定理** #Courses/MITx/6.431 1. Lecture 19 overview and slides 概览 This lecture introduces, discusses, and applies...

**Lecture 21. The Bernoulli process 伯努利过程** #Courses/MITx/6.431 **1. Lecture 21 overview and slides** In this lecture we introduce the Bernoulli process, which...

#Courses/MITx/18.6501x **1. Hypothesis tests for Linear Regression**

#Courses/MITx/18.6501x 1. Modes of Convergence $X_n$ 是一个随机变量序列,如果他与随机变量 $X$ 具有以下关系,认为 $X_n \rightarrow X$ 具有收敛性。 Convergence almost surely 几乎处处收敛 definition:...

#Courses/MITx/18.6501x **1. Distances between probability distribution** Recitation problem statement TBC.

#Courses/MITx/18.6501x 1. Other methods of estimation Objectives At the end of this lecture, you will be able to do the following: Extend the principles of...

#Courses/MITx/18.6501x 1. Goals of Unit 4 2. Introduction to Parametric Hypothesis Testing 参数假设检验导论 Objectives 目标 At the end of this lecture, you will be able...

#Courses/MITx/18.6501x 1. The Wald Test Objectives At the end of this lecture, you will be able to do the following: Construct one-sample and two-sample Wald...

#Courses/MITx/18.6501x 1. Objectives At the end of this lecture, you will be able to do the following: Identify situations in which you cannot use the Wald...

#Courses/MITx/18.6501x 1. Objectives Multiple Hypothesis Testing At the end of this lecture, you will be able to do the following: Understand and avoid the...

**Lecture 15. Goodness of Fit Test for Discrete Distributions** 对离散分布的拟合优度检验 #Courses/MITx/18.6501x 1. Objectives At the end of this lecture, you will be able...

**Lecture 18. Introduction to Bayesian Statistics 贝叶斯统计导论** #Courses/MITx/18.6501x 1. Motivation 动机 2. Objectives Bayesian Statistics Part 1 At the end of this...

#Courses/MITx/18.6501x 1. Parametric Estimation and Confidence Intervals 参数估计与置信区间 Objectives 目标 At the end of this lecture, you will be able to Distinguish...

#Courses/MITx/18.6501x 1. Confidence Intervals, the Delta Method, and Hypothesis Testing Objectives At the end of this lecture, you will be able to: Apply the...

#Courses/MITx/18.6501x 1. Motivation 2. Objective 目标 Total Variation Distance, Kullback-Leibler (KL) divergence, and the Maximum Likelihood Principle At the...

#Courses/MITx/18.6501x 1. Objectives Maximum Likelihood Estimation At the end of this lecture, you will be able to do the following: Compute the likelihood of...

#Courses/MITx/18.6501x 1. Examples of Maximum Likelihood Estimators Objectives At the end of this lecture, you will be able to compute the maximum likelihood...

#Courses/MITx/18.6501x 1. Statistical properties of the MLE Objectives At the end of this lecture, you will be able to do the following: Derive the maximum...

#Courses/MITx/18.6501x **1. M-Estimation**

#Courses/MITx/18.6501x 1. (Review) Method of Moments Gamma Method of Moments 我们希望的是用m1和m2的某些组合方程形式来表示α和β。即: $$ \alpha = g_1(m_1, m_2), \quad \beta = g_2(m_1,...

#Courses/MITx/18.6501x **1. Proof of Cochran's Theorem and T Test**

**Lecture 1. Introduction to Machine Learning 机器学习导论** #Courses/MITx/6.86x 1. Unit 1 Overview...

**Lecture 1. What is statistics 什么是统计** #Courses/MITx/18.6501x 1. Motivation 2. What is statistics 3. Overall goal of this course Welcome to 18.6501x! This...

**Lecture 2. Probability Redux 概率论复习** #Courses/MITx/18.6501x 1. Objectives 目标 Recall the statements of the (strong/weak) law of large numbers and the central...

#Courses/MITx/18.6501x **1. Objectives** 目标 **Multivariate Linear Regression** 多元线性回归 At the end of this lecture, you will be able to Write down the...

**Lecture 3. Parametric Statistic Models 参数统计模型** #Courses/MITx/18.6501x 1. Motivation 动机 2. Objectives Parametric Statistical Models At the end of this...

**Lecture 8. Introduction to Feedforward Neural Networks 前馈神经网络导论** #Courses/MITx/6.86x 1. Unit 3 Overview At the end of this unit, you will be able to...

**MITx 18.6501x Fundamentals of Statistics | 统计学基础** #Courses/MITx/18.6501x #Statistics & Machine Learning# Brief Introduction 课程简介 Instructor: Professor...

**MITx 6.431x Probability - The Science of Uncertainty and Data | 概率论** #Courses/MITx/6.431 Brief Introduction 课程简介 Instructor: Syllabus 课程大纲 Unit 0. Overview...

**MITx 6.86x Machine Learning with Python-From Linear Models to Deep Learning | Python机器学习** #Courses/MITx/6.86x #Statistics & Machine Learning# Brief...

**Project 3: Digit recongition (Part 2) 数字识别** #Courses/MITx/6.86x 1. 用numpy写一个两层的前馈神经网络 模型结构: 3. Activation Functions The first step is to design the...

**[Lecture 20] Linear Regression 1 线性回归1** #Stats-ML #Courses/MITx/18.6501x **1. Motivation** 动机 **2. Objectives** Linear Regression At the end of this...

**[Lecture 18] Inequalities, convergence, and the Weak Law of Large Numbers 不等式,收敛性与弱大数定律** #Statistics & Machine Learning# #Courses/MITx/6.431 1. Lecture 18...

**[Lecture 20] An introduction to classical statistics 经典统计导论** #Stats-ML #Courses/MITx/6.431 1. Lecture 20 overview and slides 概览 This lecture provides a...

**MITx MicroMasters Program in Statistics and Data Science** #Courses/MITx #Statistics & Machine Learning/DeepLearning# Probability 概率论 [[MITx 6.431x...

Let's face it - Life is uncertain

周报这个题材是学的https://www.pseudoyu.com/posts 的博客风格,但人家能保持每两周写一篇,我还是算了吧:)

在经历了三个月6.431x和18.6501的摧残后,今天难得的拥有了一个自由的周末写写久违的博客,虽然个人域名又忘了续费。

从5月到8月,这三个月几乎所有的周末和工作日闲暇时间都献给了这两门课,我果然还是too young too simple sometimes naive,天真的以为『老子概率统计学得很好啊这不是随便刷吗』。概率那门课还好,但统计确实恼火,在知乎上看参与了MIT这个项目课程制作的一个博士说18.6501原型是数学系的课,怪不得充斥着大量的证明和渐进理论。好处是上完课之后再看一些论文里涉及到概率统计相关的公式和理论就觉得so easy啦。

这三个月的重心都放在了上课上面,但工作过于繁忙(瞎忙),以至于出差的时候全程都带着ipad mini。在两舱休息室做题,在公务舱看lecture和拿着A4草稿纸算题,空姐大概会以为我是个赶作业DDL的大学生吧,笑。

2025.6.11 @ 成都双流国际机场

2025.6.21 @ 家

说到工作,本来打算这次年中绩效出来就内部活水,提前也联系了几个部门同意接收,前提是这次得拿个M+。我以为这大半年工作表演也算尽心尽力,该拿的一些虚头巴脑的奖也拿完了,就算不是嫡,绩效总该给个M+了吧——结果也还是too young too simple sometimes naive——仍然只给了M。果不其然谈好的活水也就gg了。

我很少在意绩效,指望『一两个傻逼就对一个人的整体工作作出一个评价』这件事本身就充满着统计学上的滑稽和荒谬(unbias but large variance)。但这次是为了想转去tt而必须有一个相对好点的绩效,所以结果还是对我预期的规划造成了一些不可控的影响。老张已经提前去了北京,而我现在只能重新去看北京的职位——甚至也在开始看外面的机会了。

这时候想起了在6.431的第一节课上,Professor说的一句话,Let's face it - Life is uncertain。

从四月开始,做各种心理量表,结果都在不约而同告诫我『你现在是重度抑郁』,但我自己感觉还好。我不知道其他的抑郁症患者为什么难以自救,和馨予聊天时我有一种结论(但不一定对):他们抑郁症的根源就来自于自己在乎的事物。而我恰好不是。是的工作很烦,现在生活也不是我想过的那种生活,一看年龄也即将35岁了却还是一塌糊涂。但我自己想的还是现在的一切都只是过眼云烟。本来计划的是今年申请硕士,但现在看来确实也没时间考语言了吧笑。但转念一想再赚两年钱也挺好。

Zx

Zx

最近开始尝试用notion来做笔记,顺便发现notion也可以拿来当博客。之前在有一篇文章里说过独立建站最大的问题是从写作到发布之间多的那几步始终挺麻烦的,特别是图床贴图(我没有一点给自己不写博客找借口的意思)。所以顺便就一起迁移到notion上了。顺便一说,财大现在给校友提供校友邮箱,所以我注册了一个校友邮箱来薅notion的免费教育版。

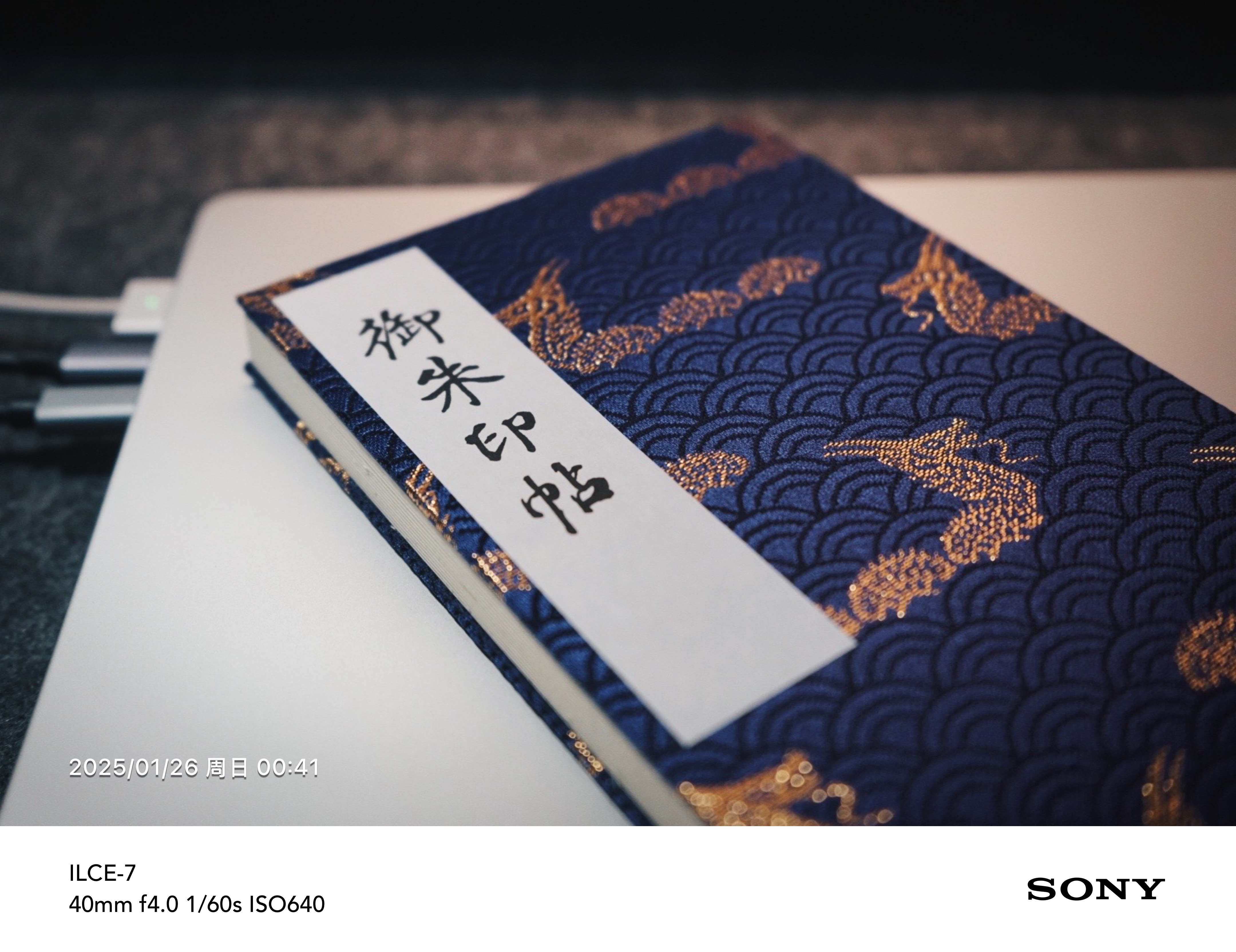

6.431x 的notes,加上封面真的挺好看

是的薅羊毛+存钱是真的会上瘾的。

希望接下来保持每两周写一次博客的习惯吧,加油鹿小葵!

#Writing/2025 #Writing/成都

墨尔本RMIT门口。

#Writing

2024年在微博上给自己立了一个OKR是「重新成为一个有趣的人」。这个「有趣」的来源,其实是翻看以前的微博时,18-19、20-21年这两段时间的整个人状态是个人最喜欢的。

抛开那时候还不满三十岁的青春生气不说,更多是工作上做着自己还比较喜欢的事情,能感受到自己的迅速成长,团队同事和老板也都是一群高学历聪明人并且少了很多傻逼间的低劣宫斗场面。

生活里,逐渐跳出舒适圈广泛涉猎各种兴趣爱好,比如穿卫衣的习惯就是18年有段时间比较迷彭昱畅时学的。那段时间也喜欢在上下班路上拿着iPhone X用nomo拍一些现在看来模仿低劣胶片质感的照片,但照片里北京二环里阳光的漏影也成为日后怀念的注脚。

18-19年外面的世界发展很快。日本那一年的流行文化恰好精准踩到我的审美点上:aimyon在18年发行了「マリーゴールド」,King Gnu发行了「白日」,official higedam发行了「pretender」。在之后的几年,这都是我听得最多的流行音乐人。流行小说上,乌贼写出了他网文生涯的巅峰之作「诡秘之主」,追得不亦乐乎。

很可惜后面就是大家都懂的三年疫情,而我也换了工作并且每天工作如上坟。24年年初,有一次翻到20年在微博和别人对线吵架,发现当时连吵架都是翻着论文引经据典言之有物,妥妥一个INTP。所以想,还是要重新成为一个「有趣」的人。

现在2024年结束了,对OKR打个分的话,只能算不及格。BTW,如果以标准的OKR的定义,这不能算是一个很好的OKR:没有量化的衡量指标,没有细拆的O和具体的执行动作,摊手。

那么,简单回顾一下2024年都做了一些什么事情,又有哪些是可以被铭记的。

工作上还是乏善可陈。2月份从美团跳回了字节,本意是想回成都而投了字节的本地生活,但因为另一半没有找到成都的工作,又被迫在北京待到了6月。

我不喜欢美团,自然地,我也不喜欢字节本地生活——这是一个超过1/3的原美团人组成的和美团类似的业务部门,与其说是字节范氛围是字节洼地,倒不如说是美团价值观复刻。另一方面,成都合适的职位只有风控运营专家——title再怎么花里胡哨也是运营,而运营是我过去最不喜欢的工种,运营的主要工作基本都踩在我的雷区上。但为了回成都,勉为其难地接了这个offer并且到现在刚好工作了一年。每一天都上班如上坟,一如在美团时一样。

很遗憾作息仍然维持了2点睡、9点半起的传统。在互联网公司工作,同时如果还想要有点属于自己的下班时间,那么晚睡几乎成了一个必然的选择。作息上给了不及格,但好像我也没什么其他的办法。

2024听的音乐总的来说也是乏善可陈的一年。

这一年听NewJeans最多,也成为了NewJeans的粉,但很可惜这一年也是NewJeans命途多舛的一年。年度歌曲是「ditto」,这一年又听了几百遍。「ditto」自带的东亚校园伤痛文学情绪在这一年里一直贯穿在我的生活心理状态中,常常在上班途中和出差的飞机上听着「ditto」突然沉默。如果看24年新发行的歌里听得最多的,大概是「Supernatural」。New Jack Swing的律动和流行式的旋律让我经常反复重播。

网易云音乐的年度歌曲是omoinotake的「几亿光年」,是一首胡子男风格的日式流行,听得多的最主要原因是旋律线条流畅顺耳,在这一年的billboard J-POP TOP10里算是一股清流了。

除此之外,还有Chante Moore在歌手上直播版本的「If I Ain’t Got You」,也是惊为天人。

首先,24年没有看完任何一本专业性的书,悔过。一方面工作确实用不到(还记得前文提到的吗?运营这个工作主要还是拉皮条和paperwork),另一方面是在美团待了两年后,已经和技术向的东西彻底脱节了,要重新捡起来需要一些勇气,并且也会常常自我质疑「这样做还有什么必要吗」。总而言之,24年在技术上是彻底垮掉的一年。

论文也没怎么看,原因同上。另外,24年全年都处在一个「我不知道自己对什么方向感兴趣」的迷茫状态中,大部分时候都是东看一点,西看一点。现在回想,这一年浅浅地了解了一下深度学习做tabular数据的新进展和时序数据的异常识别,但都只是浅尝辄止。也重新看了一下可解释性机器学习、因果推断在业界的使用,但书也没怎么看完。

公开课or网课,这一年也是0。

这一年的代码量甚至小于了100行——SQL不算。以至于某一次需要用Python做一个比较detail的数据分析的时候,连基本的语法都忘得干干净净,摊手。

这一年完本的小说里没有什么是印象特别深刻的,看虚构小说更多是阶段性找个事情消磨时间,与19年狂热地追诡秘的连载截然不同。

但得益于从24年下半年开始骤然增多的出差频率,让我重新拾起了飞机上用iPad Mini看书的习惯。

这一年首先把断断续续拖了好几年的「大灭绝时代」,在10月18号广州飞成都的3U6714航班上看完了。除了六次生物灭绝带来的情感冲击外,另一方面我还是很向往书里那些科学家们做田野调查和科研的生活方式。

在此之后,「教育的浪费」看了一半弃书:这真的是一个经济学家写的么,车轱辘话来回折腾。

然后是「像火箭科学家一样思考」,我以为作者会讲自己负责好奇号、机遇号的火星探测项目中的经验,但读到后面越来越像一本略拙劣的成功学著作。

「太白金星有点烦」:略微超出预期的快餐文,马伯庸难得的没有烂尾,字数也不多,记得好像一个来回航班就看完了。

24年因为跳槽的缘故,旅行频率比23年低了很多。

1月元旦节去了厦门,2月春节去了乐山,10月国庆去了拉萨,11月的一个周末去了九寨沟,12月底为了刷川航积分去了一趟鄂尔多斯。这就是24年的全部旅行行程。

BTW,因为出差的缘故,差不多每3周会飞一次北京,趁机把川航刷到了白金卡。但不得不说川航现在的飞机餐甚至不如国航,如果不是因为身为四川人对川航和熊猫有家乡滤镜,我大概率会弃川航改刷国航……

24年在数码产品上几乎没有任何的更新。

24年进电影院的次数也屈指可数。

当年新上映的新电影里,「朱同在三年级丢失了超能力」是相对更喜欢的一部,除此之外「从21世纪安全撤离」也还不错,但应该没什么二刷的冲动。

如果抛开「新上映」这一限制,24年最喜欢的是「宇宙探索编辑部」,这也是一部人人都觉得我一定会第一时间看但我居然硬生生拖了三年才开始看的电影。在这里直接引用我在豆瓣上留的短评吧:

拖了很久终于把这部电影看了。除了故事大部分剧情发生在我的家乡以至于带来了一些陌生的熟悉感之外,其他时候我总是会想起小时候看的科幻世界,想买而家长一直不肯买的天文望远镜,以及曾经想过的,「朝闻道」里也提过的问题,宇宙的意义是什么。大概是一个中年社畜不会再去深入思考的问题吧,笑。

其次是「花束般的恋爱」,感触太多以至于不知道怎么写短评。

2024年过去了,这是乏善可陈的一年,年度盘点也只需要花一个晚上的时间就可以匆匆总结。如果一定要用一个量化的指标来打个分,我可能会给到6分:及格。给到一个及格分数,是因为这一年肉眼可见地做出了改变:离开北京,回到成都。下半年虽然过得比较混乱,但这也许是从一种生活状态中脱离,尚未准备好进入另一种生活状态的过渡阵痛。

可能接下来会再写一个2025年的计划。拖24年时不时思考的福,25年的计划,大概不会再像24年一样,是一个不合格的OKR了吧,笑。

#Writing

很遗憾一次性并不能全部写完。

第四天天气又恢复了晴朗。 这一天主要是在浅草寺和逛庙会。

雷门,全是人。

在浅草寺看到了米家三件套之绝区零的宣传海报,至此三件套的广告全部get。不愧是米桑的故乡。

浅草寺主体建筑

刚好遇到了元旦祈祷大会,我们也排队进去参观了一会儿。

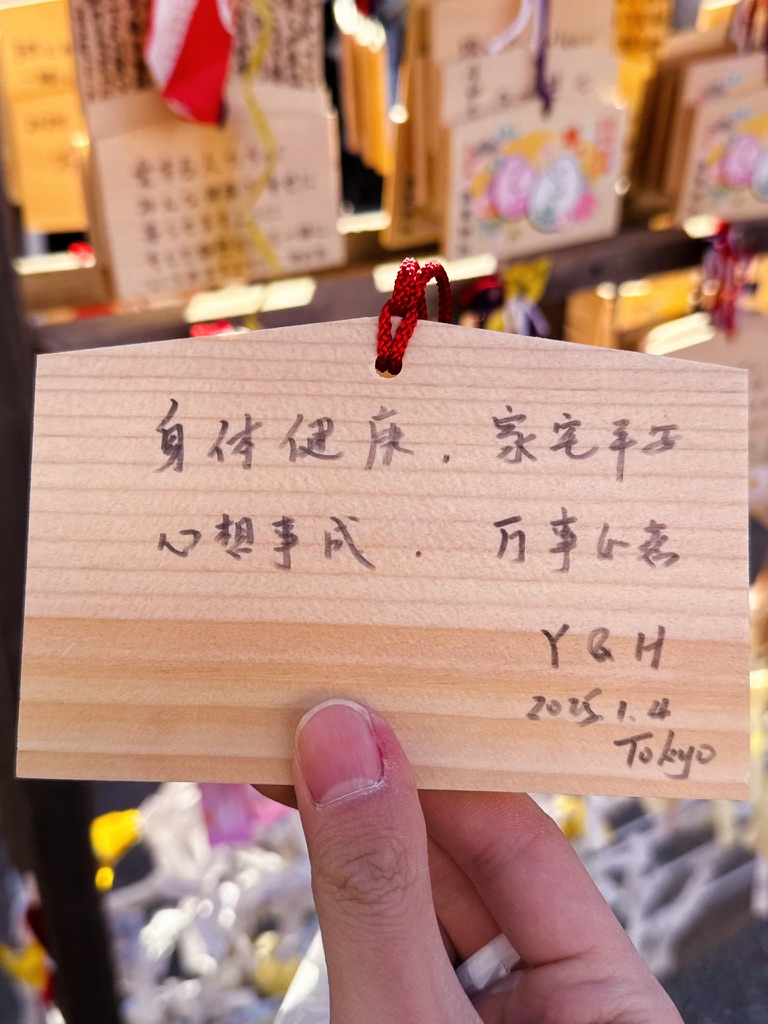

也买了一个蛇年主题的绘马,挂在了浅草寺。

在浅草寺买了御朱印小本本,一直排队盖御朱印。BTW,这是唯一一处必须懂一点日语才可以交流的场景。盖御朱印的流程是:

万幸的是我日语虽然几乎忘光了,但数字好歹还记得一些,所以我和老张分别是617和618号,也算能听得懂。

当时在日本没有拍御朱印的图,今晚在成都写这篇博客的时候翻出了我沉寂已久的SONY A7拍了两张,不得不感叹相机的效果就是比手机好太多。

1月4号在浅草寺刚好也是庙会时间,全是卖小吃的摊贩,我们午饭主要就是靠各种小吃吃饱的。不过当时我人应该是比较疲惫,就没拍照片,现在想想还是有点后悔。

5号早上和老张商量想买个iPhone 16 Pro,因为我确实不太喜欢现在的15 Pro Max屏幕太大。但日本现在的iPhone也比较容易缺货,所以5号早上起一大早就跑新宿的几个电器城:Bic Camera、山田电机等等。但最后跑了大概五六个电器城还是缺货,遂放弃。

新宿地铁站出口的鸽子

中午吃了一家干拌拉面,我和老张各点了一份「地狱辣」,一开始还不屑:日本的地狱辣能有多辣,我打算面不改色吃完之后面对服务员不可置信的眼神,轻飘飘留下一句「私たちは四川人です」。结果吃到一半我和老张就已经被辣的面红耳赤不停喝水,最后也没把面吃完就灰溜溜走了……

下午从羽田机场搭国航CA134飞北京,这架飞机的舷窗玻璃被划得过于花,以至于每张照片都拍出了梦核版的朦胧感。不得不说,日本城市规划与建筑物的规整感是真让人身心愉悦。

经验教训:

#Writing

很遗憾一次性并不能全部写完。

到日本的前两天天气都很好,以至于我们有一种“沿海城市可能每天都是蓝天白云吧”的错觉。第三天就给了当头一棒,早上起床拉开窗帘就发现是个阴天。

第三天主要去了东京大学和东京国立博物馆,因为天气的缘故,照片也没有拍很多。

东大是这次旅行时一早就计划会去的目的地。我和老张两个人都有逛大学的习惯,在疫情前的旅行基本都会去当地的大学校园走一走。但国内因为疫情的缘故,很多大学趁疫情封控之机封闭了校门,疫情解封后也一直拖延不肯开放,社会上一直有抨击的舆论和声音。直到2024年才开始逐渐有大学开放,但据我个人观察绝大部分国内高校目前游客想进入还是非常困难的一件事(例如需要提前预约、或只给校友身份开放权限等),所以「逛大学」这件事,只能在国外实现了:(

但不幸的是,元旦节刚好也是日本春节,学生都放假了,东大的整个校园都冷冷清清,里面只有零星的几个游客。食堂、纪念品店统统没开门。我们在里面拍了几张照片就离开了,打算五月份再重新去一次。

从东大出来吃午饭,找了一家校门附近的餐馆,进去后女服务员第一句是「いらっしゃいませ」(欢迎光临),但她抬头看了我们一眼,第二句话就改成了字正腔圆的中文:「楼上有座位」。我点了一个小炒牛肉盖饭套餐,老板亲自在二楼炒菜,一边问我能不能吃辣,我说我是四川人。吃饭中和老板聊天,老板自述是第一批留学生,八十年代从大连来日本留学,已经几十年了。他妈妈是成都人,所以还问了我一下成都的近况。

中途有三个女生也上二楼来吃饭,老板习惯性用日语问几个人,为首的一个女生稍微有些怯生生地说「さんにんです」(三个人),然后很快老板也发现这是中国人,于是大家又愉快地切换成中文对话。因为已经过了饭点,整个二楼就我们两桌人,各自都在用中文聊天,有种在国内吃饭的错觉。

盖饭的味道还不错,牛肉的肉质和国内有区别,可能是美国牛肉?笑

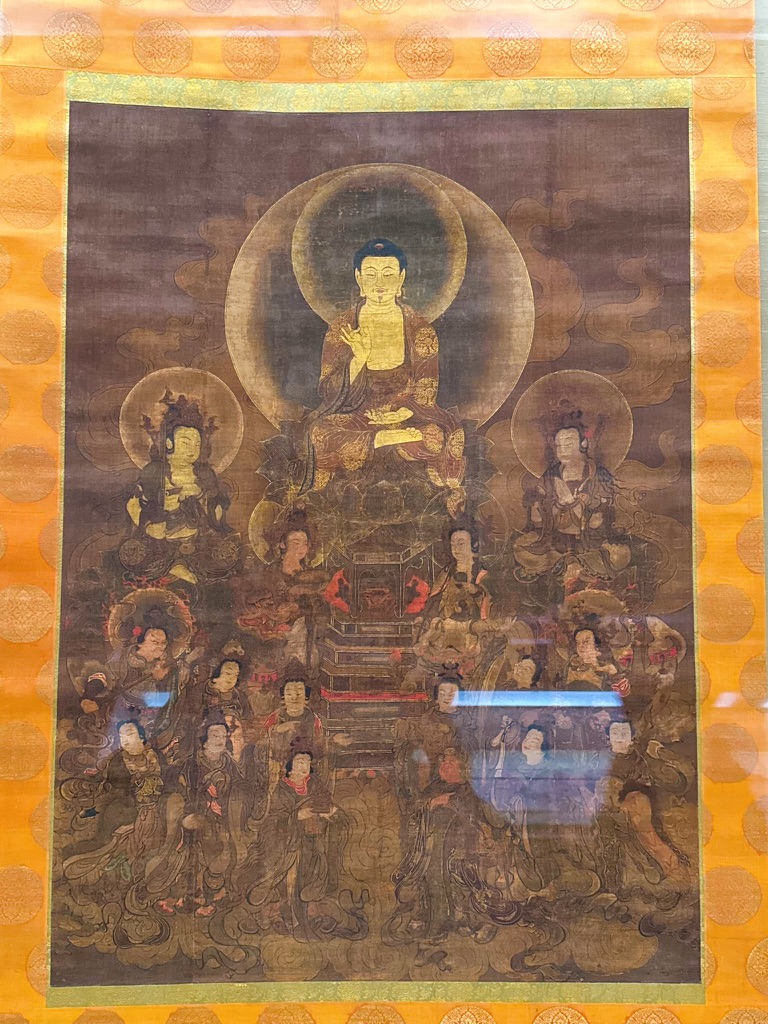

东博也是原定计划中的地点,从东大出来之后我们选择走路去东博,路上大概走了半个小时。东博人蛮多的,而且当天因为天气不好、气温偏低,有冷风吹得我头疼,在东博的时间也不够多,就只逛了主馆。东博的纪念品倒是买得挺多的。

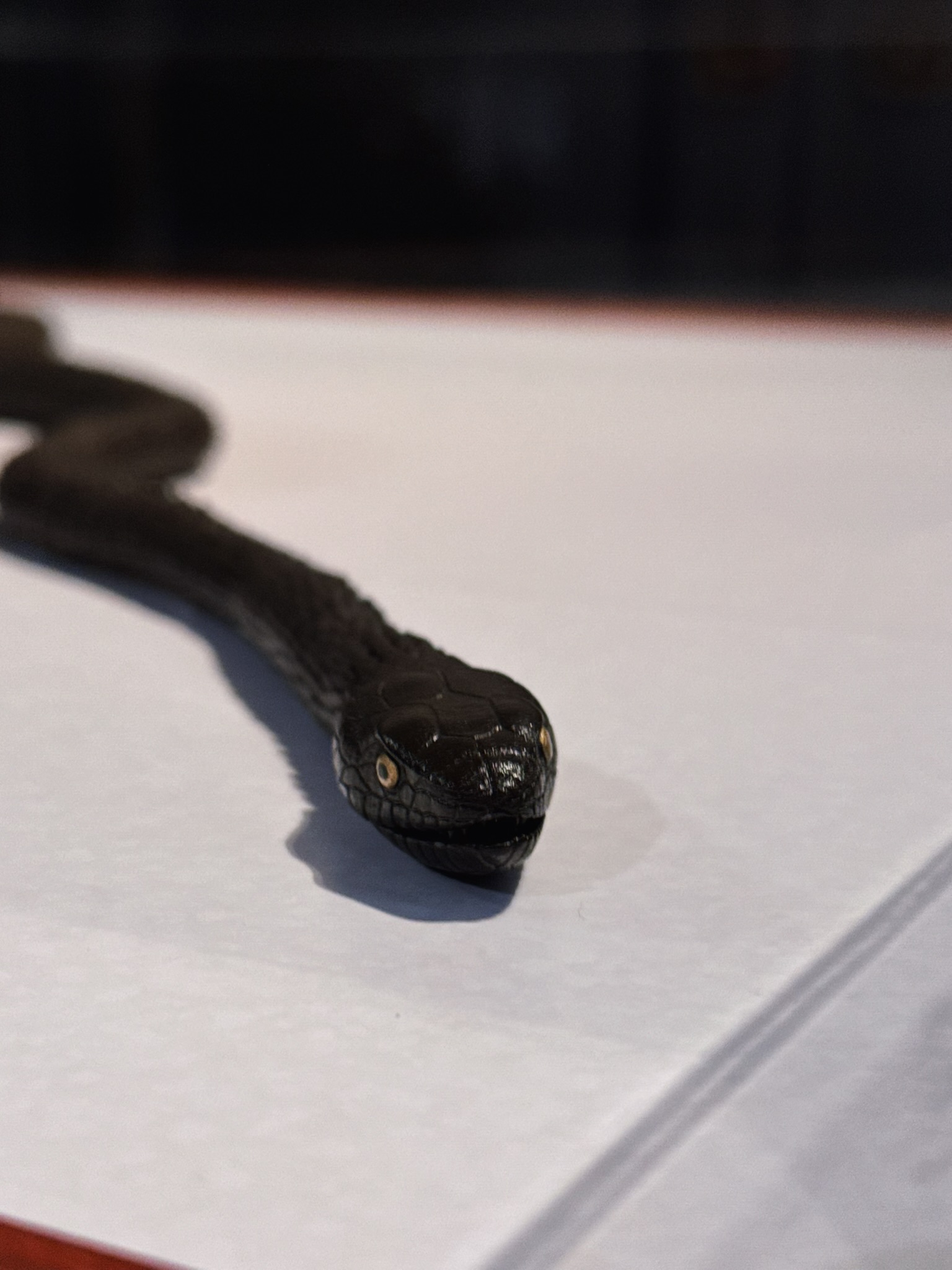

东博给蛇年单独开了个展馆,这个蛇可以动,设计的也挺好看。

东博的展品里我最喜欢的反而是浮世绘系列,有个展厅专门展出了很多浮世绘作品,葛饰北斋的也有不少,但我没看到神奈川冲浪里。在这个展厅可能看的太认真,反而忘了拍照,没留下一张照片纪念。

从主馆出来的庭院景观也有种秋风萧瑟的意思。

1月3号刚好在东博有hello ketty的特展,我们提前买了票也进去看了看。虽然两个男人对hello ketty向来是不怎么感冒的。

hello ketty特展里我觉得最好玩的是和东博的几个镇馆之宝的联动:比如「神奈川冲浪里 X hello ketty」之类的梗图。所以在参观完后的纪念品店也买了几个这一主题的画。

从东博出来天色已暗,也来不及逛上野公园和其他的几个博物馆了。在附近的商圈找到了一个美式牛排的店吃了晚饭,我选了牛排+日式酱汁,味道也挺好的。

说起来这次在日本几乎没怎么吃当地特色,我对Omakase也毫无兴趣,还是资本主义大口吃肉的生活方式更让我开心。

第三天的两个景点都不算逛得很彻底,也不是一次性能逛得完的,所以期待五月再去的时候会有不一样的风景。

#Writing

晚上回到酒店闲着无事,下楼抽根烟,然后发现我骑到酒店的美团单车还停在原地,心血来潮又骑上了车。

从中关村皇冠假日出发,沿着中关村南大街,一直骑到国图,来回大概十公里。

路过海淀医院,想起我在这里打过的狂犬疫苗,被猫在家里跑酷时抓伤的手背上依然还有一条很长的疤痕并且肉眼可见会持续下去。

路过人大,想起2018年刚来字节的时候和当时的ld明珠一起上班时间跑去听那一年的R语言会议,还记得那年主会场的主讲是范剑青但我听了一半差点睡过去。

路过北理工,想起那几年考FRM时总是要去北外,最后一次酒店定在了北理工旁的汉庭,一大早再穿过北理的校园。啊我自己读书的时候都没起这么早过。

路过国图,想起刚来北京的时候曾经进去过一次,却因为身份证消磁而又没真正进去过。

骑车时耳机里随机听着歌。很巧合的是那些歌曲从我近几年爱听的新歌一路回溯往前,就像思绪在北京夏夜晚风中被一路裹挟着逆流而上。想起了和昊哥在罗庄西里一起度过的新冠时期的爱情,想起了在回龙观和成龙一起每天下班后骑着单车沿着东大街西大街来回穿巡,想起了在财大东门空无一人的半夜三更漫步,想起了高考结束后和朋友们通宵KTV。想起了我也曾经想拥有自由而快乐的一生。

几天前离开北京的时候过于匆忙,以至于今晚短暂的心血来潮让我在快乐的骑行中渐渐意识到,原来这才是一次真正意义上的,突如其来的道别。

#Writing

很遗憾一次性并不能全部写完。

国内一般把**お台場**翻译成「御台场」,主要是受到数码兽大冒险第一部(digimon adventure 01,以下简称DA)的台版音译,お在日语里的一个用法是表示对对方的尊敬,所以翻译为「御」。实际上日常里一般就直接叫成「台场」。

御台场是数码兽大冒险在现实世界里的故事主要发生场景,而DA的制作方富士电视台使用了台场大量的实地景点(甚至贡献了自家电视台的大球供战斗暴龙兽去打怨毒吸血魔兽……)。在DA02里,「御台场纪念日」成为了动漫里的一个专有名词,纪念现实世界的这一段经历。

对国内DA的粉丝而言,去御台场的圣地巡礼几乎已经成为了一个例行活动。我还在高中时,贴吧里有个在新浪新闻工作的老哥,就经常在贴吧里发台场的实景拍摄贴。老张在这次东京旅行里特地安排了一天台场之行,感谢科技进步,ChatGPT甚至可以提供御台场圣地巡礼的完美路线图和典型景点实物对比图。

1月2号早上起床,天气非常好,能见度极高。我们选择临时调整旅游计划,早上直接从新桥坐临海线去台场海滨公园。临海线是地上运行的轻轨,我们选了一个车头的车厢,方便从车窗看城市的景色。

白天的东京塔

### 台场海滨公园站

台场海滨公园站下车。这一站其实只在DA的剧场版「我们的战争游戏」里出现了一个镜头,但大家似乎都喜欢把站牌当成是圣地巡礼的第一站,大概都是因为从这里下轻轨方便拍摄吧:)

台场海滨公园站

台场站台

#### 太一&光的公寓

台场出来可以走路到的就是太一和光住的公寓。这是著名景点,从DA的TV版到剧场版都频繁出镜。印象中,这一栋公寓以前还在楼下立了个牌子介绍这是太一的家,这次去公寓找了半天也没找到,估计是撤了吧,毕竟整个digimon的热度不管是在中日都已经江河日下了。

太一家的公寓

这个全家也在剧场版出镜过

#### 台场海滨公园

从公寓走出来不太远就到了台场海滨公园。很幸运的,我遇到了第二个抽烟区。这次在日本我特意没有买打火机,一路都靠抽烟区找人借火。在台场海滨公园的抽烟区,遇到一个像是环卫的大爷,借火也很顺利。

台场海滨公园是我这次在东京见过的最美好、最漂亮的风景,阳光蓝天白云+平静的海平面,手机随便一拍就可以作为壁纸。海边步道和沙滩上有不少平静的游客与遛狗的当地人,最难得的是整个环境非常安静,甚至可以听到大海被微风吹得泛起波光的哗啦声。

彩虹桥

坐船点

过于好的天气

沿着海滨公园散步,在Aqua City台场找了一家海鲜盖饭的定食店,叫「筑地食堂 源」。BTW,这个店是在点评上也有收录,可能中国人去得多,提供的菜单也有中文。我点了个生鱼海鲜盖饭,很难得没什么腥味儿。吃完饭和老张在商场里逛了会儿ニトリ,宜家青春版,我记得国内好像在上海也开了一家。

吃完饭,又去看了一下台场的东京自由女神像(自由の女神像(台場),这是1999年为纪念日本与法国友好关系时建造的法国自由女神像的复制品。同时也在digimon 2000剧场版「我们的战争游戏」里出现过。

自由女神像

#### 富士电视台/富士产经集团大楼/FCG大楼

然后就是本次旅行的重头戏:富士电视台。当然我们的主要目的是为了去那个大球。富士电视台大楼是丹下健三设计修建的(丹下健三是日本第一位普利兹克奖得主,但其实我并没有觉得富士电视台修得很好看,丹下健三的香川县厅舍更符合我的审美:))。富士电视台的球体观光厅对外售票,从球体内部可以俯瞰台场绝大部分景观。

富士电视台

我印象最深刻的是从球体往下看其他建筑时,看到修建在建筑楼顶的篮球场和停车场,有人在打篮球。之所以印象深刻,那一瞬间我突然想到超级马里奥奥德赛的都市国(New Donk City)里我见过几乎一模一样的场景:高耸入云的摩天楼、马里奥在楼顶与楼顶间穿梭、楼顶停着汽车、有人正在打篮球、你甚至可以操纵马里奥用帽子去干扰他们。17年玩奥德赛的时候就觉得这个画面很好玩,现在想想,大概游戏设计师的灵感就来源于东京的这些现实场景吧。

#### The Gundam Base Tokyo,鰻丼,东京塔

最后又去了Diver City Tokyo看了下高达模型,在专卖店买了一点手办,就到了吃晚饭的时间。晚饭我们去了池袋吃晚饭,去了一家做鳗鱼饭的店,我点了一个双倍鳗鱼三吃,花了大概10000円,但确实烤得好吃(写到这里我突然饿了……

高达

鳗鱼饭

吃完饭,从池袋回到东京塔,顺利赶在TOP DECK TOUR的预定时间排上队。欣赏东京夜景。可惜这次去东京没带相机,而手机拍夜景还是差点意思。

### 总结

台场的风光可以让我坐一上午。池袋也不是传闻中的全是中国人。鳗鱼饭真好吃啊( ̄▽ ̄)"

#Writing

很遗憾一次性并不能全部写完。

很难想象作为一个将日本流行文化作为超过一半的娱乐生活的人居然没有去过东京,上次和朋友聊到的时候,对方也很吃惊。我将其总结为一种『近乡情怯』的微妙情感:了解得越多、越想准备好、越准备不好的恶性循环。

2024年换工作回字节、回成都之后,还是能感觉到比在美团忙碌很多,以至于24年一整年都没怎么旅行,遑论出国。老张作为一个爱旅行的人,在24年底的时候订了元旦五天四夜的东京之旅,我咬牙元旦节请了两天假,顺利出行。

去程坐的是川航从成都直飞东京成田。飞机快降落的时候,看到大片规整的农田,冬日的昏黄氤氲光线,虽然同为东半球北纬30°~40°的地理分布,但每个像素都透露着异国他乡的熟稔感。坐成田特慢花了一个半小时才到新桥,老张斥巨资订的东京汐留皇家花园酒店,房间非常小,主打东京塔景观。我们到酒店的时候刚好当地时间五点,赶上了东京日落,于是看到了夕阳、东京塔和富士山同框的无敌画面。

东京塔毕竟太过于熟悉,作为东京地标活跃在无数影视文学动漫作品里,也时常出现在我的手机和电脑壁纸上。我们决定在新桥附近随便找了一家麦当劳(BTW,每次去日本都必然有一顿饭是靠麦当劳解决,老张为数不多会的几个日语单词就是搞笑式的makudo narudo,感谢黄明志tokyo bon的普及,笑)。吃完晚饭就徒步去东京塔。

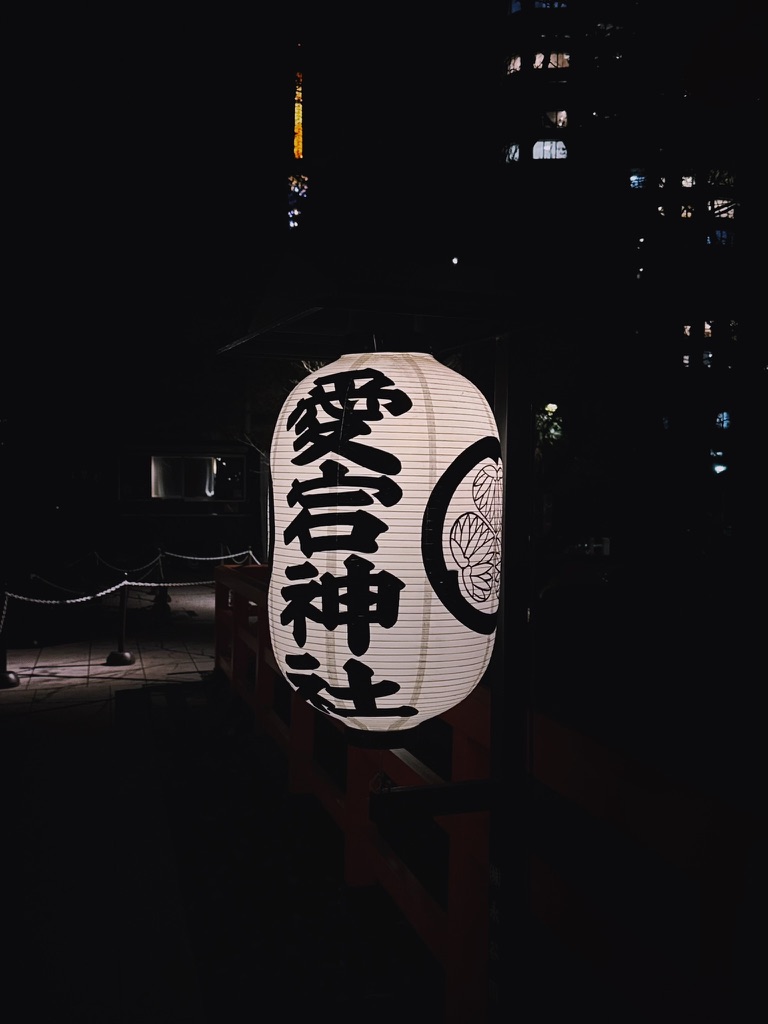

徒步过程中偶遇爱宕神社神社,我们爬石梯上去闲逛了一下,本也打算顺便祈个福,无奈排队游客太多,外加这个神社供奉的神主要保佑防火,与我们关系不大,遂作罢。

爱宕神社还有个称号是東京23区最高峰の神社。

东京塔的近景也是很美的,打卡点全是外国游客排队拍照。我挑了一个仰视角度,偶然发现东京塔下半部分纵横交错的竖直钢筋很像是细田守在「我们的战争游戏」里战斗暴龙兽打大菠萝兽的背景构图。

到现场再买东京塔的top deck tour需要等两个小时,我们商量了下决定可以改天在网上订票,当晚去其他地方逛逛。于是坐地铁直接去了涩谷。印象中,在我小时候涩谷并不算特别出名,只有涩谷辣妹这种我迄今为止都无法欣赏的审美。但毕竟是游客必打卡点。从汐留到涩谷明显感觉到人流骤然变多,张灯结彩和鳞次栉比的广告牌,等待着红绿灯过十字路口的人潮,以及我在东京发现的第一个吸烟点。老张说,「这才是印象中的日本嘛」。

从涉谷站出地铁就是忠犬八公雕像,但拍照的人还是太多,我们挑了个合影游客换人的空隙赶紧拍了两张,回成都带给香蕉看。

在涉谷抽了两根烟,去mont-bell买了件羽绒服,丑归丑,但的确轻薄保暖,现在已经是我的日常最爱冬季外套了。去唐吉坷德买了一堆小玩意儿和纪念品,排队结账时从喧嚣吵闹的人群中听到了商场广播放的歌是「几亿光年」。哦omoinotake实火,我的2024年年歌。

地铁里的广告是原神,火神玛薇卡up,不愧是米桑故乡

忠犬八公

涉谷十字路口

涉谷商业街

作为强迫症患者,想把游记写得面面俱到事无巨细,而这对一个INTP&完美主义者来说是一件异常痛苦的事情。过去也去了很多地方,回来后总是在脑子里开始打草稿,但想得越多越难以下笔,最后拖延着拖延着也就像时间一样流逝过去了。上一篇博客是2023年4月,在这一年半中,其实发生了很多人生大事。例如23年沿着丝绸之路的轨迹去了银川、敦煌、喀什、乌鲁木齐,跳槽回了字节生活服务然而发现这只是一个美团plus, 从工作生活了整整九年的北京举家搬迁回了成都,办好了日韩五年签并且第一次去了大阪,还完了房贷然而又想着换一套更好的房子,头发越掉越少:(

神经细胞无法再生,记忆也并不像想象中那么牢靠,最终还是需要记录到互联网的某个地方,可以让自己在未来的某一天重新翻开,重温当时瞬间的快乐。所以我能想到的一个缓释措施就是将一个大而全的文章拆成一段段独立的博客来写,就像这次的东京之旅一样。

デイバイデイ

どんなスピードで 追いかけたら

また君と 巡り逢えるだろう

寄り添った日々 生きている意味

くれたのは君 なんだよ

>

日复一日

该用多快的速度追赶才好

才能与你再次辗转相遇

相依相伴的日子 活下去的意义

将这些给我的都是你啊

#Writing

这是一篇久违了四年的博客。

这几年很少对外表达,包括博客、微博、朋友圈。一方面自我感觉没什么实质上的收获和可以对外分享的东西,另一方面大概也是对自己的生活并不是特别满意。另外,在自建的博客上发表一篇完整的文章苏需要的工序还蛮多的,这种形式感会不自觉地对内容的规整性有要求,所以往往刚起了一个念头就半途而废。

总之,憋了半天,今天终于憋出来一篇。

春节的后半段和男朋友去了一次贵阳,这是三年疫情结束后的第一次旅行。贵阳索菲特的体感一般,设施比较老,大厅的大理石地面隐约透露着擦不干净的污渍,大概只有“在市中心”这一个优势。从楼上俯瞰甲秀楼是一种比较美好的体验,前提是贵阳难得的有一个晴天。

当天晚上去了一趟传说中的亚洲最大小区花果园,膜拜了传说中的白宫。可惜晚上看不太清楚花果园超高密度小区的全貌,少了一些震惊感。

第二天爬了黔灵山和弘福寺,很遗憾那天遇到贵阳的一个什么活动,黔灵山人山人海,一半的时间都花在排队坐索道上了。黔灵山的猴子有点峨眉山猴子的风韵,但可能是疫情三年喂的人比较少,暂时还没有达到峨眉山猴子的恶劣程度。

第三天去了一次文昌阁+青岩古镇+吃了酸汤牛肉。爬了一个类似长城的古城墙(然而我迄今为止还没有去过长城)。

工作上没有太多值得说的内容,赚个钱而已,没什么激情。

有了一次三天跑三个城市的出差经历,周一从北京首都飞成都天府去太保调研,周二从成都坐动车去重庆去理赔团队调研,周三从重庆回北京。最深的体会是,年纪大了果然经不起连轴转,事实证明那一周的周四到周日都昏昏沉沉精疲力尽。

买的关于保险和精算的书还是没有动过,摊手。

二月主要玩的还是冒险岛。创世终于满解,在突破和洗潜能上又花了亿点点钱。

这个月玩原神比较少,时间和精力不太够用。夜兰6+5了,但手感感觉不如崩崩呢。

二月听新裤子(NewJanes)的Ditto, 胡子男的White Noise和Subtitle。

2018年到19年听得比较多的乐队和歌手,比如aimyon,米津玄师,胡子男,到2023年没想到是胡子男的歌在继续突破和抓耳。

提起这三位,就不得不回想起那时候还在字节,在5号线的地铁上,在东华门的阳光与阴影里,单曲循环过的『marigold』,『pretender』,『flamingo』…

是的,回到美团已经一年半了,我仍然怀念和喜欢着字节。

毫 无 进 展。

昨天男朋友在家里看李沐在B站上的论文导读,『attention is all you need』,很遗憾发现我连encoder和decoder都忘了……

2月在北京发现一家很好吃的川菜店,然而他在点评里的POI竟然是一家足疗……

另外,在安定门附近有一家重庆小面,面的浇头不错。他们家的口水鸡的做法和一般的不太一样,会剔掉鸡皮,反而比较适合我的胃口。

归根结底是乏善可陈的二月。

北京的冬天很难让人喜欢待在室外,有种人生被偷走了一半的失落感。

所以春天啊,快来吧。

#Writing/2023

男,四川土著,~~帅且可爱~~。 不吐槽会死星人。理性,毒舌,孤僻,宅。 会弹琴,常听J-Rock, J-Pop, Folks, Original Soundtrack。喜欢 いきものがかり (生物股长), Aimyon , Mr.Children , 宋冬野, 陈致逸 。 专业是金融,毕业之后做了几年支付、信贷风险策略,误打误撞进了保险行业做策略。 常混迹于北京各大互联网公司的金融事业部。 朝阳区惠新西街群众。 想读PhD拖了八年的重度拖延症患者。

#Writing

我是HeYan,男,四川土著,~~帅且可爱~~,🌈。理性,INTP,热爱科学,并且有点宅。会弹琴,常听J-Rock, J-Pop, Folks, Original Soundtrack。喜欢 いきものがかり (生物股长),Aimyon ,陈致逸 。现在常住在北京。

现在就职于美团保险,并负责一个小的两核策略团队。在回到美团之前,我在字节跳动有过两段工作履历,负责建立了抖音支付最早期的风险管理体系以及做过一段时间的贷前信用策略,并且交到了几个很好的朋友。字节跳动带给了我迄今为止的工作经历中最棒的体验。在此期间有过短暂的银行风险经理的工作。在加入字节跳动之前,在美团支付团队负责支付风险管理。更早的时候,在支付宝做支付方向的风控,那是毕业之后的第一份工作。

在工作之前,我在四川成都的西南财经大学度过了四年本科生活,我很喜欢成都这座城市,所以在成都买了一套贷款三十年的房子(~~虽然迄今为止入住的时间总和不超过一个月,计算ROI是一笔非常失败的投资~~)。

想读PhD拖了八年的重度拖延症患者,但我相信时间会在三十五岁之前给我一个答案。感兴趣的领域包括宏观金融、资本市场、机器学习与统计。在此之外也对编曲与作曲抱有极大的兴趣。

有一只叫做何包蛋的三岁美国短毛猫,一只叫做香蕉的四岁柴犬,以及一个男朋友,他在游戏行业从事数据分析工作。我们都希望能够环游世界。

#Writing

昨天开始正式步入了『二十岁』这个区间的最后一个年头,但是特别忙,和京东来的人开会,去瓜子做贷后检查,然后五点回公司又帮同事check代码,晚上还开了个data的汇报会,回家躺沙发上居然就这么直接睡着了,想写点感想也没机会。

我常常在想自己的这二十多年过得还是蛮有意思的。驱魔少年钢炼凉宫夏日大作战fate周杰伦蔡依林SHE生物股长Mr.Children&aimyon生活大爆炸西部世界还有一大堆数不清人类科技娱乐和艺术的结晶,都在不同的时间和空间下构成了我的性格和回忆的一部分。

读书的时候热衷于穿衬衫和纯色毛衣好像可以让自己显得成熟一点,真快到30岁了又天天套头卫衣和迷彩裤,连上班都随意地穿小米运动鞋只因为走路舒服。昨天上班时抽空下楼抽烟遇到一个推销招行信用卡的哥们和我搭讪,随意聊到工作多久了我说我工作五年了28岁小哥恭维一句看不出来啊跟刚毕业一样,我差点习惯性低下头给他瞅『你看我脱发哟』,笑。

二十岁这十年分别被成都杭州和北京这三座城市瓜分,今年突然意识到北京已经成了除了家乡之外我呆的时间第二长的地方,对望京回龙观和惠新西街南口周边无比熟稔,然而还是没有胆量去尝试豆汁儿卤煮炒肝和爆肚儿。

记得以前每年生日和新年也会装模作样写一番规划但反正从来没有实现过,我就是计划的巨人行动的矮子然而这样过着日子似乎也并不坏。就像是每个基于历史数据训练的模型AUC和KS再高也只是当前各种约束条件下的最优选择,也会在时间变量的推移中迅速衰减。

小时候想当个天文学家,中学时觉得自己辩论(吵架)厉害适合当律师,大学又以为会在华尔街中环陆家嘴金融街做个西装革履天天打飞的看项目的投行狗或者在四大累死累活审底稿看财务的审计狗,结果毕业去了互联网做PM和分析师天天和别人扯统计和机器学习模型,最后跳到这家小银行做credit risk时居然能在深圳出差时和微众税银的人讲会计折旧方法对净利润的影响。

然而最让我无力的大概是时间的线性增长。古川流老贼沉迷打麻将不再续凉宫,生活大爆炸在freestyle的吉他慢板主题曲中落下帷幕,生物股长放了两年牧又合体,京阿尼今年的灾难带走了好几个我熟悉的人名以至于我重新看2006年的凉宫的时候不忍心看字幕的staff出现他们的名字。只能默念几遍,Que sera sera,一切都会过去。

我也很难去预测接下来的一年和十年会发生什么,但正如去年年底循环过好多遍艾怡良的forever young,永远年轻,像一个少年一样。

#Writing

1.

距离春节五月有余,终于又一次离开北京前往上海,为aimyon上海演唱会以及平安京三人组首次当面开黑。

上一次正经听演唱会是15年北京五棵松的Rie Fu, 以及16(还是17?)的好妹妹工体。其实北京也开了不少演唱会,但一直没心情去参加。大概成年以后愈发懒散,对任何事情都提不起兴趣。这次Aimyon难得来一次上海,恰好这半年都常听她的歌,所以买了内场票,又奢侈一把定了个静安洲际,开始第n次上海游。

2.

天公不作美,高铁进入南京开始就一直阴雨连绵,到上海的时候恰好倾盆大雨。

害得我本来就稀疏的头发在湿气的夹击之下纷纷败下阵来,贴着头皮,别提多丑。

打车到静安洲际,赶紧把头发吹干,换了件衣服之后,就和SY去旁边的大悦城吃饭,等师兄。

在大悦城五楼的momo牧场门口,正在发微信问师兄到哪里了,我抬头看到一个唇红齿白的少年,穿着黑色TEE和绿色短裤,向我和SY走来,挥手。心想卧槽,这小哥好帅,难道是师兄?

3.

这小哥还真是师兄,我感觉自己顿时遭受到了一万点打击。说好的30岁中年男人呢,为什么少年感如此强烈,像个二十出头的小孩…

我第一次理解所有的脆皮鸭小说里描述男主角的“唇红齿白”“明眸皓齿”,具现在我面前,以至于我有点不敢多看两眼。

在此往后的三天里,和SY、师兄一起吃饭打游戏和撸猫的时候,一直忍不住偷瞄师兄的嘴唇。薄薄的,红红的,粉粉嫩嫩的,说话的时候上下轻启,我竟然有一种想咬上去的冲动。

咳咳,大概真是寂寞太久了吧。

4.

Aimyon演唱会在世博中心红厅,我提前一个小时到的,本以为到早了,结果看到路边全是陆陆续续往世博中心走的人们,不少人手里还提着个袋子放着一朵万寿菊。

入场之后旁边坐一小哥,喷的香水略浓,穿衬衫,拿着一本竖排的人间失格在看。

必然是基佬!

Aimyon登场第一首就是《不听摇滚的你》,当场就差点吼出来了,可惜这首不太会唱,只会副歌那几句,尴尬- -

基本把新专辑的歌都唱完了,然后九点谢幕,又在大家encore里返场,响起《marigold》的前奏。这时候第一排的一个小哥站起来对后面所有人招手,让大家都起来,会唱的不会唱的都在跟着

麦わらの帽子の君が

戴着麦秸帽子的你

揺れたマリーゴールドに似てる

仿若摇曳的万寿菊般

あれは空がまだ青い夏のこと

那是天空蔚蓝的夏日

懐かしいと笑えたあの日の恋

令人怀念的、开怀的那日的热恋

真是令人怀念的,开怀的,上海之行啊。

5.

接下来三天都是在师兄家,在酒店里,我们三个人一起开黑,每晚打到两点钟,但是我好想还是得业生…

开黑真好玩,我还要玩。

发现师兄除了嘴唇很红之外,竟然还有胸肌,黑色皮卡丘TEE下面隐约可见胸前起伏的两块。

嗯,他弯腰找咖喱的时候,屁股还很翘,被绿色短裤包裹着完美的伏线。

当晚回酒店之后默默拿出手机开始搜,如何让嘴唇变红润。

6.

周一回北京,G4。

上高铁前买了一杯星爸爸的美式,打算高铁上看看书。

然后打开一篇Airbnb KDD2018的做dynamic pricing的论文,醒了看,看了睡,睡醒了继续看。

最后一共看了三页。

BTW,邻座小姐姐吃的德州扒鸡太特么香了…

在高铁上靠窗坐着的时候想,这段经历大概也会成为2019年难忘的回忆吧。

一定。

#Writing/游记 #Writing/上海 #Writing/2019

FRM终于出坑了。

从毕业开始断断续续看书、考试,每次都是没复习完就匆匆上考场被虐四个小时再下来,以后再也不像这样了……

接下来是CFA和CPA。

以及还有一堆网课要刷呢。

#Writing/2019 #Writing/杂谈

上周去参加了猫眼学院的公开课第一期,主讲是关雅荻。

作为一个从幼儿园到大学都生活在女生远多于男生(譬如文科班,财大,金融,etc.)的环境中的人,坐在这次公开课的观众群体第二排时的确有一些「熟稔」的感觉,氛围与气场让我更舒适和游刃有余,心态上的轻松感非常明显。

大概是因为猫眼电影本质上算是文化公司?(呃,互联网买票的)

还是因为我在程序猿野蛮生长的世界里呆得太久但是仍然有种格格不入的隔阂感?

有一次MH说“天啊你上班居然三天没换衣服了简直不是以前的你。”

这个时候我的表情大概是「只需要微笑就好了T^T」。

所以我想还是要做出一些改变啊。

#Writing

最近写博客的频率骤降,快要变成每月一次的节奏。

最近忙得兵荒马乱,昨天一边洗澡一边想,除了“兵荒马乱”这个已经被我用滥的词之外还有什么词语可以形容忙得一团糟的生活,答案是还真想不起来。

哎,毕竟不看小说好多年。

最近忙些什么呢,考试什么的,反正过去了。一直在酝酿写这篇博客,大概人都是在压力之下不自觉地想去寻找一个发泄口。这种情绪在周五晚上时愈发明显。那天我在魏公村北理工的东北门订了一个酒店,磨磨蹭蹭去麦当劳吃完晚饭往回走时,在北理工的校园里逛了逛。

北京的深秋分外美,比如落叶和稍显凛冽的晚风。路过一个教学楼时,鬼使神差跟着前面的小哥走了进去,一进大厅就看到一个老式的开水器,来来往往皆是穿得臃肿小声背书的学生。诧异了一小下就反应了过来,哦,快考研了呢。

那个老式开水器是一切回忆的根源,在成都的每个冬天的自习,总是假装去打水暖手而从自习室里溜出去晃荡,而考研的时候更是明显,主要打完水之后可以趁机看一眼旁边自习室的帅小哥。反正一切都过去得了无痕迹,只余下残存的记忆碎片在某个不经意的时刻偶尔跑出来供人凭吊。

周六考完试之后滚回家睡了一觉,下午五点钟起床洗漱完毕穿上衬衫和V领毛衣出门,在公司加了一个美食俱乐部,大家约着周六晚在三里屯喝精酿啤酒。

不得不说这是一次比较成功的聚会,虽然所有同事都是第一次见,但聊天过程却意外熟悉,大概是有种大学同学身上的味道。精酿啤酒逼格虽然略高,但后半程大家还是喝成了像路边摊普通啤酒一样玩游戏输了的人罚一杯。

所以这个时候突然对公司的印象好了不少,毕竟之前和同部门同事一直不在一个聊天的层面上,估计真是进错了部门吧哈哈。

和朋友讨论《我不是潘金莲》的时候起了些争执,我从1942之后就再也不看冯小刚的电影,对他的人品颇有微词,而朋友相反。说着说着,突然想起一句台词:

1997年过去了,我很怀念它。

这句词出自冯小刚1997年末的贺岁电影《甲方乙方》的最后一句。当想起这句台词的时候,突然有一种巨大的,排山倒海的东西迎面扑来,毫无抵抗力。

然后就莫名其妙湿了眼眶。

我这该死的多愁善感啊。

于是因为考完试而无所事事的周末,把《甲方乙方》正经地看了一遍。1997年的海报,希望工程募捐,葛优大爷喝水的搪瓷杯,下半截漆成绿色的上世纪室内建筑风格,都是属于某个我曾经历过但却消逝无踪的年代的回忆。

葛优和刘蓓坐的公交车背后写的标语是,“学习李素丽”。李素丽出现在我的中学政治课本的阅读材料里,模范公交车售票员。而十九年后,公交车已经基本实现了无人售票,北京城里还能见到售票员的话,更多是为解决本地人口就业而设的福利性岗位。

正如常常向朋友感叹的,这个时代发展太快,我总有种跟不上的乏力感。

电影最出名的画面应该是最后一幕,除夕夜,大红灯笼高高挂,镜头最远处是杨立新落寞的背影和色调陡然转冷的下雪天。然后葛优低沉的声音响起。

那天我们都喝醉了,也都哭了

互相说了许多肝胆相照的话,真是难忘的一夜

>

几天后我和北燕正式举行了婚礼

她的父母单独跟我谈了一次话,问我是否隐瞒了年龄

我告诉他们,我从一出生,就比一般的孩子老。

>

1997年过去了。我很怀念它。

其实1997年已经过去了好久好久,我也不知道我在怀念什么。

北京今晚开始下雪,又是一个轮回,2016仅剩一个多月,在北国的暖气里,怀念1997年。

借我十年

借我亡命天涯的勇敢

借我说得出口的旦旦誓言

借我孤绝如初见

>

>

借我不惧碾压的鲜活

借我生猛与莽撞不问明天

借我一束光照亮黯淡

借我笑颜灿烂如春天

>

>

>

借我杀死庸碌的情怀

借我纵容的悲怆与哭喊

借我怦然心动如往昔

借我安适的清晨与傍晚

#Writing

本文发表于2014年5月7日

mini2里只有一个游戏,就是flappy bird。

我不是那么无趣的一个人,这类单调枯燥的游戏一向是没啥耐心玩下去的。

但是这游戏火的时间很巧,刚好是一月,考研挂了滚回家混吃等死的寒假。每天去宇宙行累死累活应付各种大妈,下班回家已经累得饭也不想吃,就躺在床上望着天花板带着耳机单曲循环《东京》。

那时候大概是觉得自己真是一个啥事儿都做不好的loser。

然后微信朋友圈里里突然开始发各种关于flappy bird的截图,不外乎是变态反人类之类。下了一个APP到手机上后也开始尝试,最开始分数就没突破过两位数。

但是也不知道为什么,一回家有空就刷几盘,然后分数慢慢往上涨,知道一天刷出140 之后,淡定地手机截屏再发朋友圈。果不其然炸开锅。

其实这游戏没啥难度,掌握好重力加速度之后就是看人品了。

重点是, 我居然从一个游戏里找自信,你看,熟能生巧而已。

然后收拾行李回学校找工作,签offer,实习,毕业……接下来的一切都感觉活在云里雾里。

自从找工作有offer在手了之后,也乐于拿自己考研那破事儿自嘲, 堵住别人嘴最好的方式不外乎就是自己抢先把话说了,让别人无话可说。

不过还是会觉得,要是当年努力一点的话,情况会有不一样吧。

后来又流行了很多游戏,2048什么的,都没去玩。

夜深人静的时候,偶尔想起这只死了千百次的黄色笨鸟,还有点小感激呢。

#Writing #Writing

本文发表于2012年9月3日

和L微博上私信,从MPAcc扯到耽美文再扯到恶搞还珠,突然她冷不丁问我CPA二审过没,我才发现自己完全忘了这档子事。一时心急登录CICPA官网才发现自己似乎忘了注册ID,那瞬间心情就像被浸到冰窖里冰冷刺骨。颤抖抖的打开注册页面却发现自己的身份证和姓名已经注册了,但又不知道密码。于是对L调侃说,可能没机会考了。

说那句话时的心情其实是带有一些窃喜的,反正自己知道自己没有复习完,但囿于面子又不好在别人面前说真心话。要是能有这样一个借口可以体体面面不去参加考试倒也不错,只是可惜了那么多报名费资料费和东奥的课程费。

不知道从什么时候开始给别人留下自己貌似很NB的印象,大概也有自己某些时候刻意装逼的原因。这叫自作孽不可活,其实自己几斤几两倒也心知肚明,周围人大概是什么水平也能摸个八九不离十。别人觉得自己很NB的一个后果就是,每次抱怨复习不完或者看不完的时候,总会感觉一阵被嘲笑的阴森感。

也不是不想像一众牛人一样把学习工作和生活安排的井井有条互不相干,也不是不想通读金融领域所有经典,也不是不想认真做一次挑战杯或者数模,也不是不想亲自操作股市期货和外汇,但自己其实从来就没有办到过。其实我就是一个很普通的SWUFE 金融系即将大三的学生而已。

后来尝试摸索用最公用的密码登陆,没想到还真成了。但是资料已经提交中注协,个人主页上什么信息都看不了。恰好明天开始打印准考证,所以将一切希望压到明天,倘若可以打印准考证,那是否应该改头换面重新做人,再剩下的一个月里给自己一个奇迹?

说起来自己是一个不相信奇迹却又寄希望于奇迹的人,一个月能复习完两科?我倒没报那么大希望。但正如昨天说的,事在人为,尽力吧。虽然自己从来就没那个毅力不玩手机不听歌不分心认认真真看书的能力,摊手,叹气。

下午醒来的时候阳光很好,用ipad刷微博看到一个很文艺的小男生,大概才高二的样子。那叫真文艺,我是伪文青。私以为真正的文艺青年会让人感觉自然舒服,就像充满了阳光香味的窗台一样。拉不下老脸去关注一个小孩子,于是更不要脸的用了偷偷关注功能。咳咳。

看财务报告一章的时候仍不能免俗的戴着耳机听歌,张悬的第一张专辑《My life will…》,

I’m trying to be perfect someday, But till now it’s still in vain 。

#Writing/杂谈 #Writing/2012 #Writing/CPA #Writing/神经质 #Writing/暑假

昨天的这个时候,大年三十,我还在北京海淀知春路中航广场的字节跳动矮楼二楼为头条的春节活动值班。大概一点过,忙得差不多,好不容易叫到一辆神州,趁师傅从二环开过来的空隙下楼抽了根烟。

大年三十的北京其实很冷清,看不到烟火,远处的高楼大概零星点亮了几户人家,然后就是死一般的寂静,烟头的火星在零下十度的寒风中摇曳。

今天的这个时候,大年初一,我在成都高新区象南里的凯悦嘉寓19楼,洗完澡湿漉漉的头发,久违地贴张面膜,坐在床边的书桌上敲着这篇距上次更新已经有半年之久的博客,听田馥甄的《爱了很久的朋友》。

去年下半年工作压力最大的时候认真考虑过回成都工作的问题。买了房之后顺其自然看装修,看车,想着买条狗,这种想法不可抑止地蔓延生长,倒过头再看北京租的地方,惠新西街八十年代的老房子,感慨二十多岁的年轻岁月怎么就磨灭在这种地方了呢。

晚上十点回酒店,脱了外套,穿一件卫衣就跑出门找附近的红旗买洗面奶和可乐。从超市出来的时候听米津玄师的flamingo,坐在仁和新城商城对面的靠椅上一边抽烟一遍打量这个城市高耸的建筑。讲道理觉得旁边那个楼盘还不错,打开链家搜了下似乎才3W一平,有点后悔之前买的房子在温江光华大道呢(笑

大概是年纪大了之后愈发向往安稳的生活吧。

今年春节例行立flag,目前的计划是把CMU的convex optimization看一半。

嗯,目前进展是看了第一个lecture的一半。

即将引来二十多天以来第一个不用设闹钟的睡眠周期。

我的一半人生

飘荡就像风筝

如果命运是风

什么又是我的绳

#Writing/2019 #Writing/杂谈 #Writing/成都

有一个大学玩得比较好的同学的小微信群,最近的讨论话题都围绕着买房、跳槽、生孩子。

很多事情做决定时总是有一大堆现实因素扯着你往地上拽,比如从SMU回成都的朋友L会因为男朋友和家庭父母原因而难以去自己想去的城市。

说着说着就突然想起我们大学的时候。有一次大二刚开学,学校举行运动会,我们一行五人就趁机去逛了一天宜家。因为我们三个金融,一个会计,一个国商,所以还在校车上欢乐地刷人人看运动会看各学院走方阵『撕逼』。

逛成都宜家的时候各种恶搞,我和WQ用iPod touch 4那500W的劣质摄像头对着各自拍了一堆低分辨率高噪点的囧照。

下午去玉林那家著名的王妈手撕兔排队买兔子,准备带回学校吃。但是一路走饿得不行,最后在人民公园附近找了一家KFC,借着吃汉堡的名义,吃完了一整只手撕兔……

最后晚上从光华校区坐校车回柳林,回宿舍前还特意去颐德楼I座实验室看被WQ吐槽了一个学期的某浓妆艳抹女老师照片。

我记得那天晚上的月亮特别圆,大概和中秋节刚过去不久有关。走在回宿舍的路上,我的iPod刚好随机到卢广仲的《慢灵魂》:

终究会习惯 这种生活

太多的困惑 我不想懂

就在没有月光的时候 流星划过我的身后

那时候以为生活大概会常常保持着这般的快乐与满足,就连十月成都乍起的晚风也吹得我那文青的小情绪纷飞。

直到很多年后才知道,中年人的世界里,想维持『从心所欲不逾矩』的少年心态原来也那么难。

#Writing/杂谈 #Writing/成都

本文发表于2014–09-01

下班之前得知上周工作小组倒数TOP1,心里居然觉得“哦”就这么过去了。反正也是不喜欢的工作,你叫我怎么提得起兴趣去做。

来杭州之前几乎不曾犹豫过,因为我始终找不到喜欢成都的理由。不止一次坐在夜晚八九点过穿梭于城市车水马龙的公交上靠着车窗听着好妹妹唱《我说今晚月光那么美,你说是的》,那时候真的天真地以为离开了会比较美好。

然后你懂的。

我在用各种方法提醒自己还是一个想读书的男人,下了班滚回家关上房门躲着室友开始背单词看Machine Learning,却悲哀地发现高强度的工作已经把大脑压迫着无法再继续学习。上班的公交上刷着微博和知乎看高频交易和算法,再不济也可以看信用评分、FICO、FRM或者财务估值,就是不想看工作相关内容。我在骄傲地宣称自己终究是学金融而非互联网公司的非技术民工小二。但是公交到古荡站然后随着上班的人流走过人行道再看到高耸的黄龙时代广场,也不由得叹一口气,手机放进裤子口袋,书包里拿出橙色工牌,又开始每日每时每分都完全相同的枯燥工作。

从转岗失败之后我几乎是已经下定了决心,于是乎这段时间的恍惚其实只是调整和平衡工作和目标之间的偏差。每天不可抑制地循环朴树和aqua timez,就像现在听着《生如夏花》能够很欢乐地写着日志一样。

你看,懂我的看到这里应该早就懂我。

也开始学着每天要生活地更快乐。拿着手机到处拍照,再用instagram和VSCO Cam调好滤镜po到微博上去;心心念念着下了班背着双肩包戴着耳机去西湖吹吹风;跑去杭州的独立通宵书店买小说;强迫自己去吃那些一点辣椒都没有的餐馆;对自己的狗更好一点;买喜欢的乐队的CD;坐这个城市公交的末班车;走路下班回家。

但是我还是没有办法爱上工作。

夏目漱石说把I LOVE YOU 翻译成“我爱你”太直白,非得译成“今晚月色真美啊”。你看,今晚的月光那么美,喜欢的乐队有新的专辑发行,晚餐时的那家饺子很好吃,白天喝了两杯咖啡一罐红牛但是都没有晚上的可乐好喝,坐电梯时旁边的小哥笑起来很好看。

然后你说,是的啊。

#Writing/杂谈 #Writing/2014

自从毕业以后,我飞的次数其实也不算少,但是还是常年恐飞,所以试过很多在飞机上缓解焦虑的方法:

听歌:通常一首歌4分钟,国内航线听30首歌就足够。不功不过。

看电影:不是一个好方法。其中最糟糕的体验是看了釜山行(封闭空间大逃杀)和星际穿越(涉及飞行器爆炸),整个人都不好了。搞不懂那些在途中看空中浩劫的人怎么想的……

看文献:刚毕业的时候还会看看券商深度研究的研报,后来因为工作性质实在差的太远,也没什么看的动力,就慢慢过度到看论文和一些互联网的文献,最好是挑逼格高的数理多的。看不看得懂是其次,主要能给人一种『啊这是人类文明的结晶,我也是能为人类做一些微小的贡献的人』的错觉,上天会格外照顾一些一样……

不过有时候巡航阶段看着窗外远方连成一线的晚霞与夕阳,夜航时地面陡然出现的灯火勾勒出城市的轮廓,以及每次北京起飞时西边连绵起伏的山脊,都会觉得还是很美的啊。

#Writing/杂谈 #Writing/2018

本文发表于2012年9月3日

在ipad上下载了《ONE PIECE》漫画,准备一次性追完。虽说是三大民工漫之首,但质量的确不错。其实是想让自己爱上了海贼王之后又能在“喜欢”这一范围内新增一系列海贼相关的周边,不追点漫画心里不是很自在的感觉。

CPA还是老样子,看起来头疼。听了一下午和晚上的课件,不禁深深怀疑光是不计效率的听完课件就需要花多少时间,想起来就害怕。谁叫之前拖得太久,看来我果真不适合在家里看书,以后别勉强自己了。

新生们开学,搞得自己也很想回去。很难想明白为什么我那么爱校,明明是个又小又破又在郊区的地方,名字也不霸气也没多少牛人出没,但还是喜欢他喜欢他一直喜欢他。

我在想自己是不是太过于去装成熟和冷静了,不少人说要是老是这样子是不可能会有人喜欢的。但很难去刻意的装嫩装可爱,不是那个年纪也不是那块料,想起来都会有一阵阵恶心的感觉。怪不得单身,不过也没办法。劝G考MPAcc,他倒是很疑惑为什么我突然开始操心起他的事。实际原因就是那天准备把QQ空间里的日志搬到点点来的时候无意中看到2010年他写的那篇纪,那句“一生的朋友”看起来略显矫情,而且毕竟从前发生了那么多事怎么可能还像两个普通朋友交往下去,但还是小小的感动了一下。

anyway,生活要继续,CPA要继续看下去。

#Writing/杂谈 #Writing/2012

#Courses/MITx/6.431

Let's face it - Life is uncertain

{s}是set(集合), A是event(事件)

#Courses/MITx/6.431

This lecture develops a method for finding the distribution (PMF or PDF) of a function of one or more random variables with known distribution.

与离散随机变量不同的是,连续随机变量的线性函数的PDF,需要对X前的系数a做放缩。

正态分布的线性变换仍然为正态分布。

接下来是对于一个一般函数g(x),求解PDF的步骤。

主要是在求解Y的PDF的时候,需要先求CDF。

但从这道题里,不用显性的写出CDF,只要能转化为 $F_X(g^{-1}(x))$ 的形式,接下来就用链式法则,直接套用公式: $f_X(\sqrt y)$ 对y求导数。

当g(x)是单调函数的时候,可以不用写出F_Y的CDF,只需要找到反函数h(y),然后套用下列公式:

$$

f_Y(y) = f_X(h(y))\left|\frac{dh}{dy}(y)\right|

$$

当x变动 $\delta_1$ 个单位时,y 变动 $\delta_2$ 个单位。我们现在将两者联系起来,可以得知:

$$

\begin{aligned}

\delta_2 \approx \delta_1 * \frac{g}{x}(x) \\ \delta_1 \approx \delta_2 * \frac{h}{y}(y)

\end{aligned}

$$

由于X和Y的变化事件的概率是相等的,即:

$$

\mathbf P(y \le Y \le y + \delta_2) = \mathbf P(x \le X \le x+\delta_1)

$$

所以有:

$$

\begin{gather}

f_Y(y)*\delta_2 \approx \mathbf P(y \le Y \le y + \delta_2) = \mathbf P(x \le X \le x+\delta_1) \approx f_X(x)*\delta_1 \\

有\\

f_Y(y)*\delta_2 \approx f_X(x) * \delta_2 * \frac{h}{y}(y)\\ 所以有:\\ f_Y(y) = f_X(x)\frac{h}{y}(y)

\end{gather}

$$

这道题的标准解法需要求联合概率密度函数的积分,但根据题目的意思,可以有渐变求法:

P(Z ≤ z) = P(sqrt(X^2 + Y^2) ≤ z)

x^2 + y^2 ≤ z^2表示以z为半径的圆,, 又因为(X, Y)均匀分布在单位圆内,所以这里求P(Z ≤ z)等于是求z为半径的圆与单位圆的面积比值,即 z^2*pi / pi = z^2

然后求导即可。

#Courses/MITx/6.431

This lecture covers two different topics:

1 the calculation of the PMF or PDF of the sum of independent random variables;

2 the concepts of covariance and correlation, and their main properties.

这个lecture主要包含两个主题:

shift的距离就是要求的Z的数值

$$

由\ f_{X+b}(x) = f_X(x-b), \\ 有\ f_{Z|X}(z|x) = f_Y(z-x)

$$

TBC

X和Y独立, cov = 0

反过来不成立,若cov = 0, X和Y不一定独立

Suppose that $X,Y$ , and $Z$ are independent random variables with unit variance. Furthermore, $\mathbf E[X]=0$ and $\mathbf E[Y]=\mathbf E[Z] = 2$ . Then, 求解 $\text{Co}v(XY, XZ) = ?$

首先按照协方差公式进行展开,这里有两种展开方式:

$$

Cov(X, Y) = E\left[(X-E[X])·(Y-E[Y])\right]

$$

一般常用下面的形式:

$$

\\ Cov(X, Y) = E(XY) - E(X)E(Y)

$$

得到:

$$

\begin{aligned}

\text{Co}v(XY, XZ) &= E[XY·XZ] = E[X^2YZ] = E[X^2]E(Y)E(Z) \\

&=(Var(X)+(E[X])^2)·E(Y)E(Z) \\

&= 4

\end{aligned}

$$

这里有两个小点不太熟悉:

1 $E[XY·XZ] = E[X^2YZ]$ 可以对随机变量的乘积进行乘法规则计算,因为E是一个线性算子;

2 $X,Y,Z$ 相互独立,可以推导出任意可测函数 $g,h,k$, $g(x), h(y), k(z)$ 也是相互独立的。

这里有一个知识点是 $\rho$ 的数学运算法则:

It is known that for a standard normal random variable $X$ , we have $E[X^3] = 0, E[X^4] = 3, E[X^5] =0, E[X^6] = 15$. Find the correlation coefficient between $X$ and $X^3$ . Enter your answer as a number.

由定义:

$$

\begin{gather}

\rho(X, X^3) = \frac{Cov(X, X^3)}{\sigma_X\sigma_{X^3}}\\ Cov(X, X^3) = E[X*X^3] - E[X]E[X^3] = E[X^4] - E[X]E[X^3]\\ 由X是标准正态分布,由E[X]=0, Var[X] = 1, E[X^2] = 1\\ 所以:Cov(X, X^3) = 3-0 = 3\\ 接下来计算方差: Var(X^3) = E[(X^3)^2] - (E[X^3])^2 \\= E[X^6]-0 = 15\\ 所以:\sigma_{X^3} = \sqrt 15 \\ 所以有,\rho(X, X^3) = \frac{3}{\sqrt15}

\end{gather}

$$

这一节主要介绍:相关不一定具有因果关系。

举例用一个隐变量Z来描述,X和Z相关、Y和Z相关,但X和Y没有关系。通过计算相关系数,可以得到 $\rho(X,Y)$ = 1/2。

这说明即使两个随机变量相关系数不为零,也不能说明他们存在因果关系。

另外有一个小trick: 如果一个随机变量X的期望为0,那么X^2的期望就等于方差。 $E[X^2] = Var(X) + (E[X])^2 = Var(X)$

#Courses/MITx/6.431

This lecture explains that the conditional expectation and variance can be viewed, more abstractly, as random variables, and presents some of their properties, concluding with an application to the calculation of the mean and variance of the sum of a random number of random variables.

textbook: 4.3和4.5章节

利用全期望公式,可以推导出:

$$

\mathbf E[\mathbf E[X|Y]] = \mathbf E[X]

$$

条件期望通常是一个随机变量,是所条件化的随机变量的函数。条件化一般就是 | 右边,所以条件期望就是右边的随机变量的函数。

TBC

这是一道题:

一根长度为 $l$ 的木棍,从一点将其截断,这一点是随机选择的,且相应概率在整根木棍上均匀分布。截断以后,留下木棍的左边部分。接下来重复以上步骤,问,在截断两次以后,剩下木棍长度的期望是多少?

记 $Y$ 是第一次截断后剩下的木棍长度, $X$ 为第二次截断以后木棍剩下的长度。因为截断点在剩下的长度 $Y$ 上均匀选择的,所以 $E[X|Y] = Y/2$。类似的,有 $E[Y] = l/2$。因此:

剩下木棍长度的期望为:

$$

\mathbf E[X] = \mathbf E[E|Y]] = \mathbf E[Y/2] = \mathbf E[Y]/2 = l/4

$$

The random variable $Q$ is uniform on $[0,1]$ . Conditioned on $Q=q$ , the random variable $X$ is Bernoulli with parameter $q$. Then, $E[X|Q]$ is equal to:

首先翻译这道题目的意思:

由于伯努利分布的期望是参数 $q$,意味着 $E[X|Q = q] = q$。

用抽象表达,即 $E[X|Q] = Q$。

这个类型的题有一个万能解法。

假设:

⠀那么,条件期望就是“参数本身”。

$$

\mathbf E[X|\Theta] = 分布的参数(参数是\Theta的函数)

$$

以预测为例:

在数学上,当你在年初的时候,对未来的销量做预测 $E[X]$。同时,你假定随时间推移,你会获得一些新的信息 $Y = y$ 来修正你的预测:revised forecast。

在新的时间节点一月底:修正预测 revised forecast : $E[X|Y=y]$

在年初的时间节点,你的修正预测 revised forecast: $E[X|Y]$。

由迭代期望率, $E[\text{revised forecast} ] = E[X] =\text{original forecast}$

意味着在给定上年的销量后,你不应该对预期销量做任何上涨或下跌的预测,而是认为新一年的销量应该等于上一年。

但这只是数学上的结果,实际工作中通常会预测销量会上涨。

总方差(无条件方差) = 条件期望的方差 + 条件方差的期望

继续上一节的练习题:

由 $Var(X|Q = q) = q(1-q)$, 可以知: $Var(X|Q) = Q(1-Q)$

由定义可知, $E[Q] = 1/2, Var(Q) = 1/12$

所以, $Var(E[X|Q]) = Var(Q) = 1/12$

$E[Var(X|Q)] = E[Q(1-Q)] = E(Q) - E[Q^2] = 1/2 - 1/3 = 1/6$

同时,利用全方差公式可以计算出:

$$

Var(X) = \mathbf E[\text{Var}(X|Q)] + \text{Var}(\mathbf E[X|Q]) = 1/6+1/12=1/4

$$

注意这里在计算 $Var(E[X|Y])$ 时,使用的是方差的定义:

$$

Var(X) = E[(X-E[X])^2]

$$

这个期望其实就是“所有可能取值下,偏差平方的加权平均”。

所以上式可以变形为:

$$

Var(X) = \sum_x\mathbf P(X = x)(x-\mathbf E[X])^2

$$

TBC

当N是一个随机变量时,随机数个变量和 $Y = X_1+X_2+…+X_N$ 也是一个随机变量。

这一页的PPT使用了两个方法来计算 $E[Y]$。

⠀最后的结果都是:

$$

\mathbf E[Y] = \mathbf E[N]·\mathbf E[X]

$$

Every person has a random number of children, drawn from a common distribution with mean 3 and variance 2. The numbers of children of each person are independent. Let $M$ be the number of grandchildren of a certain person. Then:

求解: $E[M], \ Var[M]$

解答:

这也是一个两层嵌套的随机变量问题。与Lecture中的例题一致。

假设每个人的孩子数量为 $N$, 同时,孩子的孩子数量为 $X$。即, $X_i$ 代表第i个孩子的孩子数量。

接下来就是套公式: $M = X_1+X_2+…+X_N$。

根据题意,有: $E[N] = E[X] = 3, Var(N) = Var(X)=2$。

$E[M] = E[N]·E[X] = 3*3 = 9$

$Var[M] = E[N]Var(X) + (E[X])^2 Var(N) = 3*2+9*2 = 24$

#Courses/MITx/6.431

In this lecture, we start by discussing the numerous domains in which inference is useful. We then develop the conceptual framework of Bayesian inference, and review the various forms of the Bayes rule. We discuss possible ways of arriving at a point estimate based on the posterior distribution, and present the relevant performance metrics, namely, the probability of error for hypothesis testing problems and the mean squared error for estimation problems.

贝叶斯统计推断的核心是将未知参数 $\theta$ 视作一个已知分布的随机变量,而频率学派则将未知参数 $\theta$ 看做一个常数。

在模型假设上,贝叶斯学派的观点是从一类已知的模型中随机选择的,引入随机变量 $\Theta$ 来刻画这一个模型;而频率学派的观点是多个待选的概率模型,每个 $\theta$ 的可能值对应一个模型。

显著性检验(Significance Testing)、假设检验(Hypothesis Testing)和极大似然估计(Maximum Likelihood Estimation, MLE) 都属于频率学派(经典统计推断)的核心方法。它们基于频率学派的框架,强调数据的重复抽样性质和参数作为固定常数的假设。

第三页PPT说的是,在求出后验分布后,如果你想用一个单独的数或者一个单独的预测来表示后验分布,有两种可以选择的方式:

在连续观测值的情况下,如果要计算over probability of error(全局错误概率),选择第二个公式会比较方便(只需要求和,不需要积分):

$$

\mathbf P(\hat\Theta \neq \Theta) = \sum_\theta\mathbf P(\hat\Theta \neq \Theta|\Theta =\theta)p_\Theta(\theta)

$$

Let $\Theta$ and $X$ be jointly continuous nonnegative random variables. A particular value $x$ of $X$ is observed and it turns out that $f_{\Theta|X}(\theta|x) = 2e^{-2\theta}$, for $\theta \ge 0$ .

The following facts may be useful: for an exponential random variable $Y$ with parameter $\lambda$ , we have $E[Y]=1/\lambda$ and $Var(Y) = 1/\lambda$ .

这道题是已经告诉了后验分布是一个指数分布,求MAP和LMS。

⠀根据定义,LMS(最小均方估计)等于 $E[\Theta|X=x]$。也就是后验分布的期望 = 1/2

还是根据定义,由于LMS是条件期望,那么均方误差就是条件方差,所以等于1/4。

如果带入数值,也可以得到:

$$

\mathbf E[(\Theta - \widehat \Theta_{LMS})^2|X=x] = \mathbf E[(\Theta - E[\Theta])^2|X=x] = Var(\Theta|X=x)

$$

MAP估计 $\hat\theta = \arg\max_\theta f_{\Theta|X}(\theta|x) = 2e^{-2\theta}$。由于后验分布是一个单调递减函数,所以在 $\theta = 0$ 处取得极大值。

还是带入定义, $\mathbf E[(\Theta - \widehat \Theta_{MAP})^2|X=x]= \mathbf E[(\Theta)^2|X=x] = E[Y^2] = Var(Y) + (E[Y])^2 = 1/4+1/4 = 1/2$

丢一枚不均匀的硬币,记正面向上的概率为 $\theta$, 并且将 $\theta$ 看做随机变量 $\Theta$ 的一个值。 $\Theta$ 的先验概率密度函数记为 $f_\Theta$。

现在考虑n次独立实验,记 $K$ 为观测到正面朝上的总次数。

首先,我们假设先验分布 $f_\Theta(·)$ 服从[0,1]之间的均匀分布。

写出后验分布:

$$

f_{\Theta|K}(\theta|k) = \frac{1*\tbinom{n}{k}\theta^k(1-\theta)^{n-k}}{p_K(k)}

$$

然后将与 $\theta$ 无关的项提出来,记为 $\frac{1}{d(n,k)}$,得到:

$$

f_{\Theta|K}(\theta|k) = \frac{1}{d(n,k)}\theta^k(1-\theta)^{n-k}

$$

这就是beta分布,参数为 $(k-1, n-k+1)$。其中+1是一个历史习惯。

现在我们假设先验分布不再是均匀分布,而是一个beta分布:

$$

f_\Theta(\theta) = \frac{1}{c}\theta^\alpha(1-\theta)^\beta, \quad \alpha, \beta \ge 0

$$

再求其后验分布,将与 $\theta$ 无关的项抽出来,可以得到:

$$

f_{\Theta|K}(\theta|k) = d*\theta^{\alpha+k}(1-\theta)^{\beta+n-k}

$$

可知,beta分布的后验分布也是beta分布。

在先验分布为均匀分布的假设下,我们求得了后验分布是一个beta分布。接下来需要分别求解点估计:MAP估计和LMS估计。

首先是MAP估计:对后验分布取对数后求导,求导数为0的极值点,得到:

$$

\hat\theta_{MAP} = k/n

$$

同时,对 $\Theta$ 随机变量可以刻画为:

$$

\hat\Theta_{MAP} = K/n

$$

然后是LMS估计。由于LMS估计是 $\theta$ 的条件期望,所以带入条件期望的公式,有:

$$

\begin{aligned}\mathbf E[\Theta|K=k] &= \int_0^1\theta f_{\Theta|K}(\theta|k)d\theta\\ &= \frac{1}{d(n,k)}\int_0^1\theta^k(1-\theta)^{n-k}d\theta \end{aligned}

$$

从后验分布的形式可知 $\frac{1}{d(n,k)}$ 是归一化常数,让后验分布的概率密度函数在[0,1]上积分等于1,所以带入PPT种蓝色方框的等式,再进行化简,有:

$$

\mathbf E[\Theta|K=k] = \frac{k+1}{n+2}

$$

Exercise: Moments of the Beta distribution

Suppose that $\Theta$ takes values in [0,1], and its PDF is of the form

$$

f_\Theta(\theta) = a\theta(1-\theta)^2, \ for \ \theta \in [0,1]

$$

where $a$ is a normalizing constant.

Use the formula:

$$

\int_0^1\theta^\alpha(1-\theta)^\beta d\theta = \frac{\alpha!\beta!}{(\alpha+\beta+1)!}

$$

首先求解 $a$:

根据定义, $\alpha = 1, \beta = 2$,带入公式,有a = 12.

其次求解 $\mathbf E[\Theta^2]$:

这是求先验信息,本体不涉及任何后验分布和后验估计。

根据定义,有:

$$

\mathbf E[\Theta^2] = \int_0^1\theta^2f_\Theta(\theta)d\theta = \int_0^1a\theta^3(1-\theta)^2d\theta = 12*1/60 = 1/5

$$

#Courses/MITx/6.431

In this lecture we focus on an important special case of inference problems in which the random variables of interest are normal and are related through linear relations. We show that the posterior distribution is also normal and examine how we can calculate the posterior mean and variance. We illustrate the methodology through a progression of increasingly complex examples, including the problem of estimating a trajectory on the basis of multiple noisy measurements.

Some of the material in this lecture is covered in Example 8.3 on page 415 and page 421, and on pages 480-482 of the textbook.

Exercise: Normal unknown and additive noise

TBC

注意这里的方差:

$\sigma_0^2$ 是 $\Theta$ 的方差; $\sigma_i^2$ 是噪声 $W_i$ 的方差。

特别的,当所有方差 $\sigma_i^2$ 都相等时,MAP的均方误差 就等于 $\sigma^2/(n+1)$。这个均方误差不依赖于样本个数,对任意一个观测值 $x_i$,均方误差都相等。

在有多个未知参数 $\Theta_0, \Theta_1, \Theta_2$ 时,求解MAP的方法还是从基本定义入手:

首先,假设给定了 $\theta_0, \theta_1, \theta_2$, 那么 $X_i \sim N(\theta_0+\theta_1*t_1+\theta_2*t^2, \sigma^2)$

然后,写出 $f_\Theta$ 的先验分布(这里有三个未知参数,意味着有三个关于 $\theta$ 的正态分布概率密度函数。

然后,写出 $f(x|\theta)$ 的分布函数,并且他们之间是独立的。

最后,联立、求导数,再分别令 $\theta_0, \theta_1, \theta_2$ 的偏导等于0,可以得到三个线性方程和三个未知数。

线性正态模型的每一个参数 $\Theta$ 的MAP估计是一个关于观测值X的线性函数: $\widehat \Theta_{MAP,j}: \text{Linear function of }X=(X_1,...,X_n)$

线性正态模型有以下良好的性质:

⠀

这一节主要讲对抛物线试验的贝叶斯统计推断。

为了更贴合实际,假设了参数 $\Theta_0 \sim N(200, 50^2)$ 代表初始点; $\Theta_1\sim N(50,50^2)$ 代表重力; $\Theta_2 = -9.81$ 代表加速度。

由此,原方程的未知参数从3个减少为两个,因此MAP估计时,对 $\Theta_2$ 的部分就直接删除了;同时,由于方差已知且相等,且与 $\theta$ 无关,所以方差项也移出不考虑。

由于未知参数的均值不再是0,所以需要对原最小化公式变形:从MAP估计的似然函数可知,如果均值发生了变化,等价于 $\theta^2 \rightarrow (\theta-\mu)^2$。

最后,这里还给出了贝叶斯置信区间的概念。由于贝叶斯估计将未知参数 $\Theta$ 视为随机变量,因此MAP估计是可以刻画出一个分布来的。在限定95%置信度下,可以得到关于点估计的概率区间。这是与频率学派不同的一点。

#Courses/MITx/6.431

In this lecture we focus on the conditional expectation estimator. We show that it minimizes both the conditional and the unconditional mean squared estimation error. We develop some its mathematical properties and also illustrate the calculation of the mean squared error.

这一段比较绕。上一节是在假设没有任何观测值的情况下,推导出了最小化MSE的参数估计:

$$

\mathbf E[(\Theta-\hat\theta)^2] : \hat\theta = \mathbf E[\Theta]

$$

那么,现在我们有观测值X = x了,最小化条件MSE的参数估计的形式是一样的,最优参数theta是在X=x时, $\Theta$ 的条件期望。

$$

\mathbf E[(\Theta-\hat\theta)^2|X=x] : \hat\theta = \mathbf E[\Theta|X=x]

$$

所以,抽象表述,LMS估计量(一个随机变量)为:

$$

\widehat \Theta = \mathbf E[\Theta|X]

$$

第二页PPT则是用到了不等式变形和迭代期望定理。

Exercise: LMS estimation

Let $\Theta$ be the bias of a coin, i.e., the probability of Heads at each toss. We assume that $\Theta$ is uniformly distributed on [0, 1]. Let $K$ be the number of Heads in 9 independent tosses.

By performing some fancy and very precise measurements on the structure of that particular coin, we determine that $\Theta = 1/3$. Find the LMS estimate of $K$ based on $\Theta$ .

这道题比较迷惑的是,求的是 $K$ 的LMS估计,而不是 $\Theta$。

因为 $K$ 是代表正面向上的次数,并且单次试验正面向上的概率为 $\Theta = 1/3$。所以我们知道:

$$

p(K|\Theta) \sim Binomial(9,1/3)

$$

根据LMS的公式(注意这里和PPT的形式不同):

$$

\hat K_{LMS} = \mathbf E[K|\Theta = \theta] = n*\theta = 9*1/3 = 3

$$

整体均方误差也是一个确定值,而不是一个随机变量?

Exercise: LMS estimation error

As in the previous exercise, let $\Theta$ be the bias of a coin, i.e., the probability of Heads at each toss. We assume that $\Theta$ is uniformly distributed on [0, 1]. Let $K$ be the number of Heads in 9 independent tosses. We have seen that the LMS estimate of $K$ is $\mathbf E[K|\Theta = \theta] = n\theta$.

第一问直接套用公式:

在给定观测值时,条件均方误差等价于条件方差。

$$

\mathbf E[(K -\mathbf E[[K|\Theta - \theta])^2|\Theta = \theta] = Var(K|\Theta = \theta) = n\theta(1-\theta) = 2

$$

第二问犯了一个错误:全局均方误差,并不是一个随机变量,而是一个确定数。全局均方误差是所有可能的 Θ 取平均后的期望误差,消除了 Θ 的随机性。

从定义上,可以推导出全局均方误差等于条件方差的期望。在这道题里,即:

$$

\mathbf E[(K -\mathbf E[[K|\Theta ])^2] = \mathbf E[Var(K|\Theta)] \\ = E[n\Theta(1-\Theta)] = nE[\Theta(1-\Theta)]

$$

注意现在 $\Theta$ 不再是条件分布了,所以根据题目定义,可知 $\Theta \sim Uniform[0,1]$。对 $\Theta$ 求期望可以视作对随机变量的函数求期望,求积分:

$$

nE[\Theta(1-\Theta)] = n\int_0^1(\theta(1-\theta)d\theta \\ = 9*1/6 = 3/2

$$

这里积分的对象应该是 $\theta$ 而不是 $x$?

这个例题中的条件均方误差,是一个关于x的函数: $Var(\Theta|X = x)$。在给定X的时候, $\Theta$ 是一个[0,x]上的均匀分布,所以条件方差 = x^2/12。

全局均方误差要更复杂一点: $\mathbf E[Var(\Theta|X)]$ 是对条件方差求平均。即:

$$

\mathbf E[Var(\Theta|X)] = \int f_X(x)\mathbf E[Var(\Theta|X=x)]dx

$$

但题目中并没有给出关于X的边缘概率密度函数,只给了联合密度函数。所以需要从联合密度函数里求解出边缘密度函数。

TBC

因为联合区域是一个直角三角形,所以 $f_{\Theta, X}(\theta, x) = 2$。

所以,边缘密度函数 $f_X(x) = \int_0^x f_{\Theta, X}(\theta, x) d\theta = 2x$。

homework重新做

#Courses/MITx/6.431

This lecture introduces, discusses, and applies the celebrated Central Limit Theorem.

Printable transcript available ~here~.

Lecture slides: ~[\[clean\]](https://courses.edx.org/asset-v1:MITx+6.431x+2T2025+type@asset+block/lectureslides_L19-clean-slides.pdf)~ ~[\[annotated\]](https://courses.edx.org/asset-v1:MITx+6.431x+2T2025+type@asset+block/lectureslides_L19-annotated-slides.pdf)~

The material in this lecture is covered in ~Section 5.4~ of the text.

Note: In all of the numerical examples in this lecture, one can of course bypass the normal table and use an online tool, such as the one found ~here~ or ~here~. Note also that such tools also allow you to go backwards, from the value of $\Phi(x)$ to the value of $x$ .

iid随机变量和的不同放缩模式

在这里,我们重新构建一个新的随机变量: $Z_n = \frac{S_n-n\mu}{\sqrt n\sigma}$。这个新构建的随机变量有良好的性质:

期望为0,方差为1。

由此,给出中心极限定理:

对任意 $z$, $\lim_{n\rightarrow\infty}\mathbf P(Z_n \le z) = \mathbf P(Z \le z)$

简单的标准正态化题目

$$

Z_n = \frac{S_n-n\mu}{\sqrt n\sigma} = \frac{M_n-\mu}{\sigma/\sqrt n}

$$

CLT的理论性质

CLT的实践应用

这一节主要展示不同的X分布下,随机变量和随n增大而逐渐趋近于正态分布。

本节介绍如何利用CLT解决问题。

第一类问题是: $P(S_n \le a) \approx b$。 在这类问题里,有n,a,b三个参数,已知其中两个,可以求第三个。

第四个案例有一些变形:这里我们不再直接求解n,a,b。问题变成:

当container的重量超过210的时候,停止装卸。求装载包裹数量 N>100的概率。

这里的变形在于:

装载包裹数量N>100的概率等同于前一百个包裹的重量都还没有超过210。所以概率变形为: $P(N>100) = P(\sum_{i=1}^{100}X_i ≤ 210)$。后面的步骤就一样了。

第七节案例的翻版

对二项分布来说,如果我们计算S_n ≤21的概率,按照二项分布的精确计算答案是0.8785。

现在我们使用CLT进行正态近似。由于S_n是一个二项分布,可以直接利用二项分布的期望与方差来进行标准正态化(对比常规的S_n,期望是nu,方差时n*sigma^2)。

以≤21算,对应的概率是0.8413,会低估概率;以≤22算,对应概率是0.9082,会高估概率。

造成这个区别的原因是,对离散分布来说,取21和22来计算结果是一样的,但对连续分布来说会多出21到22的这一段概率。这一段概率是否该被计算?答案是只有一部分需要被计算,因此可以取中点,即计算≤21.5的概率。这时候算出来的概率为0.8790,就非常接近二项分布的精确概率了。

如果对离散变量计算一个精确值的概率:例如S_n = 19,那么我们在做正态近似的时候,采用1/2 correlation:计算 18.5 ≤ S_n ≤ 19.5的概率。这个结果与二项分布精确计算的概率十分接近。

重新看选举问题,上一节里我们是用切比雪夫不等式和WLLN来求解的一个误差上界,但不够精确。

现在用正态近似来重新求解这道题:

首先是将原概率标准正态化,转化为一个正态分布求概率问题。

$P(|M_n-p| ≥ 0.01) = P(|Z_n| ≥ \frac{0.01\sqrt n}{\sigma}) \approx P(|Z| ≥ \frac{0.01\sqrt n}{\sigma})$

由于右边带有 $\sigma = \sqrt{p(1-p}$,无法精确求解,所以选择取sigma的最大值 1/2。

然后打开绝对值,令单侧分布概率为0.025,求解出误差上界为0.046。

如果要精确让误差在5%,可以算出n = 9604。

#Courses/MITx/6.431

In this lecture we introduce the Bernoulli process, which consists of a sequence of independent trials. We study various associated random variables (e.g., number of successes, arrival time of the th success, time between consecutive successes, etc.). We also discuss the merging and splitting of Bernoulli arrival streams.

伯努利过程是最简单的随机过程,本质上是一个独立伯努利实验的序列, $X_i$。

对每个实验 $i$ :

关键假设:

随机过程有两种理解的方式:

复习伯努利过程的已知性质。

视作一个二项分布,PMF、期望、方差已知。

将其视作为一个几何分布

这道题做错了

#Courses/MITx/18.6501x

#Courses/MITx/18.6501x

$X_n$ 是一个随机变量序列,如果他与随机变量 $X$ 具有以下关系,认为 $X_n \rightarrow X$ 具有收敛性。

definition:

$$

\begin{align}

X_n \xrightarrow[n\rightarrow\infty]{a.s}X,\ \text{iff } \mathbf P(X_n\xrightarrow[n\rightarrow\infty]{}X) = 1\\ 等价于: \lim_{n\rightarrow\infty}X_n = X

\end{align}

$$

definition:

$$

\begin{align}

X_n \xrightarrow[n\rightarrow\infty]{p}X,\quad \text{iff } \forall \epsilon > 0, \ \mathbf P(|X_n -X| > \epsilon) \xrightarrow[n\rightarrow\infty]{} 0\\ 等价于: \lim_{n\rightarrow\infty}P(|X_n-X|>\epsilon) = 0

\end{align}

$$

definition:

$$

\begin{align}

X_n \xrightarrow[n\rightarrow\infty]{d}X,\quad \text{iff } F_{X_n}(x) \xrightarrow[n\rightarrow\infty]{}F_X(x) \\ 等价于: \lim_{n\rightarrow\infty}F_{X_n}(x) = F_X(x)

\end{align}

$$

定义 $U \sim \text{Unif}[0,1], \ X_n = U + U^n$.

证明: $X_n \xrightarrow[a.s]{n\rightarrow\infty} U$。

证明这个性质需要用到全概率定理(law of total probability):

Law of Total Probability

$S$ 是样本空间(sample space),将其分为两个互斥空间: $S = S_1\coprod S_2$.

for any given event A:

$P(A) = P(A|S_1)P(S_1) + P(A|S_2)P(S_2)$

现在分阶段讨论U的收敛性:

1 U < 1: $$P(X_n

#Courses/MITx/18.6501x

Recitation problem statement

TBC.

#Courses/MITx/18.6501x

At the end of this lecture, you will be able to do the following:

M: minimization

我们可以将KL散度替换为任意的损失函数,只要这个损失函数能够转化为期望形式,后面的推导步骤就与MLE类似。

关键的统计技巧(statistical trick)来定义M-estimator是用均值(average)来代替期望(expectation)。

如果我们定义损失函数 loss function $\rho(x,\mu)$,有以下形式:

$$

\mu ^* = \arg\min\limits_{\mu\in \mathbb R} \mathbb{E}_{X\sim \mathbf{P}}[\rho(X,\mu)]

$$

利用统计技巧,将期望替换为均值,那么有:

$$

\hat\mu = \arg\min\limits_{\mu\in \mathbb R}\frac{1}{n}\sum\limits_{i=1}^n[\rho(X_i, \mu)]

$$

这里的 $\hat \mu$ 是 $\rho(x, \mu)$ 的M-estimator.

使用M-estimator的问题是,如何找到一个合适的 $\rho$,来代表我们想计算的统计量(期望/方差/中位数/其他分位数)?

下面,通过一个例子:定义 $\rho(x, \mu) = (x-\mu)^2$, 推导对 $\mu$ 求一阶导,可以得到 $\mu = \mu^*$。说明这个损失损失函数是求期望 $E(X)$。

以下是期望、中位数的损失函数 $\rho$ 定义。

特别的,如果想定义一个求分位数的损失函数,用到的技巧是:

绝对值损失函数 $\rho(x, \mu) = |x-\mu|$ 是一个对称函数, $\mu^*$ 是中位数。那么将这个函数进行倾斜(等于重心进行了偏移),那么这个Check function就可以求解任何分位数 $\alpha$。

Let $X_1, … ,X_n$ be i.i.d. with some unknown distribution $\mathbf{P}$ and an associated parameter $\mu^*$ on a sample space $E$. We make no modeling assumption that $\mathbf{P}$ is from any particular family of distributions.

An M-estimator $\widehat \mu$ of the parameter $\mu^*$ is the argmin of an estimator of a function $\mathcal{Q}(\mu)$ of the parameter which satisfies the following:

⠀In general, the goal is to find the loss function $\rho$ such that $\mathcal{Q}(\mu) = \mathbb{E} [\rho(X, \mu)]$ has the properties stated above.

Note that the function $\rho(X, \mu)$ is in particular a function of the random variable $X$ and the expectation in $\mathbb{E} [\rho(X, \mu)]$ is to be taken against the true distribution $\mathbf P$ of $X$, with associated parameter value $\mu^*$.

Because $\mathcal Q(\mu)$ is an expectation, we can construct a (consistent) estimator of $\mathcal Q(\mu)$ by replacing the expectation in its definition by the sample mean.

这道题很复杂

首先是median of 连续随机变量X的定义为 $med(X) \in \mathbb R$:

$$

P(X > \text{med}(X)) = P (X < \text{med}(X)) = \frac{1}{2}

$$

在这个问题中,我们要求解的是:任意median符合下列条件:

$$

\text{med}(X) = \arg\min_{\mu\in\mathbb R}\mathbb E[|X-\mu|]

$$

Step1: 用密度函数 $f(x)$ 来表示 $\mathbb E[|X-\mu|]$:

按照期望的定义:

$$

\begin{aligned} \mathbb E[|X-\mu|] &= \int_{-\infty}^{+\infty}|x-\mu|f(x)dx \\ &= \int_{-\infty}^{\mu}(\mu-x)f(x)dx + \int_{\mu}^{+\infty}(x-\mu)f(x)dx \\ &= \int_{\mu}^{+\infty}xf(x)dx - \int_{-\infty}^{\mu}xf(x)dx - \mu(\int_{\mu}^{+\infty}f(x)dx - \int_{-\infty}^{\mu}f(x)dx)

\end{aligned}

$$

Step2: 令 $\mathcal Q(\mu) = \mathbb E[|X-\mu|]$, 对 $\mu$ 求导:

$$

\begin{aligned} \frac{d}{d\mu}\left(\int_\mu^\infty xf(x)dx\right) &= -\mu f(\mu) \quad \text{利用积分基本定理}\\ \frac{d}{d\mu}\left(\int_{-\infty}^\mu xf(x)dx\right) &= \mu f(\mu) \end{aligned}

$$

$$

\frac{d}{d\mu}\left(\mu(\int_{\mu}^{+\infty}f(x)dx - \int_{-\infty}^{\mu}f(x)dx)\right) \\ = (\int_{\mu}^{+\infty}f(x)dx - \int_{-\infty}^{\mu}f(x)dx) + \mu*(-f(\mu)-f(\mu)) \\ = \int_{\mu}^{+\infty}f(x)dx - \int_{-\infty}^{\mu}f(x)dx - 2\mu f(\mu)

$$

合并结果,得到:

$$

\begin{aligned} \mathbb E[|X-\mu|] &= -\mu f(\mu) - \mu f(\mu) - \int_{\mu}^{+\infty}f(x)dx + \int_{-\infty}^{\mu}f(x)dx + 2\mu f(\mu) \\ &= \int_{-\infty}^{\mu}f(x)dx - \int_{\mu}^{+\infty}f(x)dx

\end{aligned}

$$

Step 3: 求解 $\mathcal Q^\prime(\text{med}(X))$:

$$

\begin{aligned} \mathcal Q^\prime(\text{med}(X)) &= \int_{-\infty}^{\text{med}(X)}f(x)dx - \int_{\text{med}(X)}^{+\infty}f(x)dx \\ &= P(X < \text{med}(X)) - P(X >\text{med}(X)) \\ &= 1/2 -1/2 \\ &= 0 \end{aligned}

$$

注意到第二问的结论,由CDF(概率分布函数)的性质,有:

$$

\begin{aligned} \mathcal Q^\prime(\mu)

&= \int_{-\infty}^{\mu}f(x)dx - \int_{\mu}^{+\infty}f(x)dx \\ &= F(\mu)-(1-F(\mu)) \\ &= 2F(\mu) -1 \end{aligned}

$$

TBC

与上一题类似

TBC

这里定义了两个新的矩阵(matrices): J matric和K matric

主要用于计算渐进方差。对比之前的MLE,这里有一些形式上的扩展变形。

⠀可以注意到,在参数为一维的特殊情况下, $\mathbf J$ 和 $\mathbf K$ 就是Fisher Information的两种等价形式。

The $\mathbf J$ and $\mathbf K$ matrices :

Let $\mathbf X_1, … , \mathbf X_n$ be i.i.d. random vector in $\mathbb R^k$ with some unknown distribution $\mathbf P$ with some associated parameter $\vec \mu^*\in\mathbb R^d$ on some sample space $E$. Let $\mathcal Q(\vec \mu) = \mathbb E[\rho(\mathbf X, \vec\mu)]$ for some function $\rho: E \times \mathcal M \rightarrow \mathbb R$ where $\mathcal M$ is the set of all possible values of the unknown true parameter $\vec\mu^*$.

Then the matrices $\mathbf J$ and $\mathbf K$ are defined as

In one dimension, i.e. $d=1$, the matrices reduce to the following:

$$

\begin{aligned} J(\mu) &= \mathbb E\left[\frac{\partial^2\rho}{\partial\mu^2}(X_1,\mu)\right] \\ K(\mu) &= \text{Var} \left[\frac{\partial\rho}{\partial\mu}(X_1,\mu)\right] \end{aligned}

$$

需要复习一下Fisher Information的推导过程。

回忆一下如何证明MLE的渐进正态性:

⠀

这一段内容描述M-估计量的渐进正态性。用于解决:

⠀Let $\mathbf X_1, … , \mathbf X_n \stackrel{\text{iid}}{\sim} \mathbf P$ . Let $\rho(x, \mu)$ denote a loss function satisfying

$$

\mu^* = \arg\min_{\mu\in\mathbb R}\mathbb E[\rho(X_1, \mu)]

$$

where $\mu^*\in\mathbb R$ is some unknown one-dimensional parameter associated with $\mathbf P$ that we would like to estimate. Let

$$

\begin{aligned} J(\mu) &= \mathbb E\left[\frac{\partial^2\rho}{\partial\mu^2}(X_1,\mu)\right] \\ K(\mu) &= \text{Var} \left[\frac{\partial\rho}{\partial\mu}(X_1,\mu)\right] \end{aligned}

$$

You construct the M-estimator $\widehat\mu$ associated $\rho$.

Assuming that the conditions for the asymptotic normality of this M-estimator hold, we have

$$

\sqrt n\frac{\widehat\mu-\mu^*}{\sqrt{J(\mu^*)^{-2}K(\mu^*)}}\xrightarrow[n\rightarrow\infty]{(d)}Q

$$

for some distribution .

根据M-estimator的渐进正态性,可以推导出 $\widehat\mu$ 的渐进方差为: $J(\mu^*)^{-2}K(\mu^*)$.

因此,

$$

\sqrt n\frac{\widehat\mu-\mu^*}{\sqrt{J(\mu^*)^{-2}K(\mu^*)}}\xrightarrow[n\rightarrow\infty]{(d)}\mathcal N(0,1)

$$

即收敛于标准正态分布(或者说极限分布Q为标准正态分布)。

这里在进行推导时利用了 $X_1$ 计算期望而非全体 $X$。因为样本满足iid,任意单一样本 $X_i$ 的分布均等同于总体分布 $\mathbf P$,使用 $X_1$ 可以代表总体分布的性质,同时避免冗余的求和符号。

trick: 计算Ber(p)的二阶矩时,既可以使用定义: $E[X^2] = \text{Var}[X] + (E[X])^2 = p(1-p)+p^2 = p$,也可以从定义上看:由于X的取值只有0和1,所以X^2的取值也是0和1,所以X^2 = X, 所以 $E[X^2] = E[X]$.

Let $X \sim \mathcal N(0,1)$. Compute its moment of order $2k+1$ for any integer $k \geq 0$.

标准正态分布的奇数阶矩恒为0。

两个证明方式:

$$

\mathbb EX^{2k+1} = \mathbb E(-X)^{2k+1} = (-1)^{2k+1}\mathbb EX^{2k+1}

$$

由于k是一个非负整数,所以 $\mathbb EX^{2k+1} =0$

指数分布的密度函数为:

$$

f_X(x) = \lambda e^{-\lambda x}, \quad x\geq0, \lambda >0

$$

矩母函数的计算公式实质上是求 $e^{tx}$ 的期望,所以有:

$$

\begin{aligned} M_X(t) &= \mathbb E[e^{tx}]=\int_0^{+\infty}e^{tx}\lambda e^{-\lambda x}dx \\ &= \lambda \int_0^{+\infty}e^{tx}e^{-\lambda x}dx \\ &= \lambda \int_0^{+\infty}e^{(t-\lambda)x}dx \end{aligned}

$$

上面的广义积分如果需要收敛,需要满足条件:指数部分<0。所以有: $t-\lambda <0$.

所以有:

$$

\begin{aligned} M_X(t) &= \lambda \int_0^{+\infty}e^{(t-\lambda)x}dx \\ &= \lambda \frac{e^{(t-\lambda)x}}{t-\lambda}\bigg|_0^{+\infty}\\ &= \lambda(0-\frac{1}{t-\lambda})\\ &= -\frac{\lambda}{t-\lambda} \quad \text{when}\quad t<\lambda \end{aligned}

$$

现在如果需要求 $\lambda = 2$ 时,X的8阶导:

$$

\begin{align}

M_X(t) = \frac{-2}{t-2} = (-2)(t-2)^{-1}

\\

m_8 = \mathbb E[X^8] = \frac{d^8}{dt^8}(-2)(t-2)^{-1}\bigg|*{t=0}

\\

由:\frac{d^k}{dx^k}\frac{1}{x} = \frac{(-1)^kk!}{x^{k+1}}

\\

有: m_8 = -2*\frac{(-1)^88!}{(t-2)^9}\bigg|*{t=0}\\ = \frac{8!}{(-2)^9}

\\

= 157.5

\end{align}

$$

Let $(E, \{\mathbf P_\theta\}*{\theta\in\Theta})$ denote a statistical model associated to a statistical experiment $X_1, …, X_n \stackrel{\text{iid}}{\sim} \mathbf P*{\theta^*}$ where $\theta^*\in\Theta$ is the true parameter. Assume that $\Theta\subset \mathbb R^d$ for some $d \geq 1$. Let $m_k{(\theta)} := \mathbf E[X^k]$ where $X \sim \mathbf P_\theta$. $m_k{(\theta)}$ is referred to as the $k$-th moment of $\mathbf P_\theta$ . Also define the moments map:

$$

\begin{aligned} \psi: \Theta &\rightarrow \mathbb R^d \\ \theta &\mapsto (m_1(\theta), m_2(\theta)..., m_d(\theta)) \end{aligned}

$$

Assume that $\psi$ is one-to-one (and hence, invertible).

Note: $\mapsto$ 用latex打是\mapsto, 代表函数映射

one-to-one: 单射

$\psi$: 希腊字母psi

设 $(E, \{\mathbf P_\theta\}*{\theta\in\Theta})$ 表示一个统计模型,对应统计实验 $X_1, …, X_n \stackrel{\text{iid}}{\sim} \mathbf P_{\theta^*}$,其中 $\theta^*\in\Theta$ 是真实参数。 假设 $\Theta\subset \mathbb R^d$ ($d \geq 1$) 。定义:

$m_k{(\theta)} := \mathbf E[X^k]$ ,其中 $X \sim \mathbf P_\theta$。

$m_k{(\theta)}$ 被称为 $\mathbf P_\theta$的 $k$ 阶矩。同时定义矩映射:

$$

\begin{aligned} \psi: \Theta &\rightarrow \mathbb R^d \\ \theta &\mapsto (m_1(\theta), m_2(\theta)..., m_d(\theta)) \end{aligned}

$$

真实参数 $\theta^*$ 等于什么?

根据定义,真实参数 $\theta^*$ 满足:

$$

\psi(\theta^*) =(m_1(\theta^*), m_2(\theta^*)..., m_d(\theta^*))

$$

由于 $\psi$ 是一一对应且可逆的,所以真实参数 $\theta^*$ 为:

$$

\theta^* =\psi^{-1}(m_1(\theta^*), m_2(\theta^*)..., m_d(\theta^*))

$$

真实参数 $\theta^*$ 的矩估计量是什么?

矩估计法的核心是用样本矩代替总体矩。对每个 $k=1,2,…,d$, 用样本矩 $\frac{1}{n}\sum_i^nX_i^k$ 来估计 $m_k(\theta^*)$。所以矩估计量为:

正态分布的矩定义:

正态分布的矩定义:

⠀接下来,我们要用样本来估计这两个矩:

⠀带入题中给定的四个样本进行计算:

$$

\widehat m_1 = 0.225,\quad \widehat m_2 = 2.3975

$$

再利用正态分布矩的定义求解期望和方差:

$$

\widehat \mu^{MM} = \widehat m_1 = 0.225\\ \widehat \sigma^{MM} = \sqrt{\widehat m_2 - \widehat m_1^2\\} = 1.5326

$$

TBC

TBC

TBC

MLE是最好的参数估计方法:虽然三种方法都具有渐进正态性,但MLE的渐进方差是最小的。MLE具有最小的边界:Cramer-Rao Lower Bound.

MLE是最好的参数估计方法:虽然三种方法都具有渐进正态性,但MLE的渐进方差是最小的。MLE具有最小的边界:Cramer-Rao Lower Bound.

#Courses/MITx/18.6501x

At the end of this lecture, you will be able to do the following:

⠀

在这个实验中,我们将预期的结果”新药物效果更好“作为了备择假设。professor说这是常用的方式,即将我们期望出现的结果作为备择假设。

一个试验(test)是一个统计量 $\psi \in \{0,1\}$,并且不依赖其他未知参数。

这个统计量经常被写成指示函数的形式: $\psi = \mathbb I\{R\}$。其中 $R$ 是一个被叫做拒绝域的事件。

简单理解这里的 $R$ 就是令 $\psi = 1$ 的事件,可以写成 $\psi = \mathbb I\{\psi = 1\}$,这是一个同义反复。

TBC

s

s

alpha 代表了 实际上拒绝了H0的试验,但不应该拒绝H0的试验次数

alpha 代表了 实际上拒绝了H0的试验,但不应该拒绝H0的试验次数

#Courses/MITx/18.6501x

At the end of this lecture, you will be able to do the following:

Wald检验只能保证在渐进等级上应用。如果样本非常小,不满足CLT,另一个可选择的检验方式是T-test。

构造Wald检验的关键步骤是构造估计量 $\hat \theta$,使之具有渐进正态性。

$$

\frac{\hat \theta - \theta}{\sqrt{\widehat{var}(\hat \theta)}} \xrightarrow[n\rightarrow\infty]{(d)}\mathcal N(0,1)

$$

其中, $\widehat{var}(\hat \theta)$ 是 $\hat \theta$ 的方差的估计量。

以伯努利分布为例, $var(\hat p) = p(1-p)/n$。 但这不是一个估计量,因为他依赖未知参数p。

所以我们需要估计他。估计的方式是加上\hat在他的上面: $\widehat{var}(\hat p) = \hat p(1-\hat p)/n$。

所以,我们重新写出上面的渐进正态性表达:

$$

\frac{\hat p-p}{\sqrt{\widehat{var}(\hat p)}} = \sqrt{n}*\frac{\hat p-p}{\hat p(1-\hat p)} \xrightarrow[n\rightarrow\infty]{(d)}\mathcal N(0,1)

$$

在零假设下,当真值等于假设值时,W收敛于N(0,1);但当真值不等于 $\theta_0$ 时,W的渐进分布就会偏移,不再是标准正态,而是“中心化项+偏移项”。

在推导Wald检验的渐进性时,需要注意:需要在 $\mathbf P_{\theta_0} 和W$ 中保持同一个 $\theta_0$。(注意在power function定义的时候求的是 $\mathbf P_\theta$,而不是 $\mathbf P_{\theta_0}$。

双侧检验:

在双侧检验时这个条件很好满足:我们假设,在零假设的条件下,最糟糕的情况概率就是 $\theta = \theta_0$。所以我们可以直接将 $\mathbf P_\theta$ 替换为 $\mathbf P_{\theta_0}$。

这时候直接利用定义求解.因为 $W=\frac{\hat \theta - \theta}{\sqrt{\widehat{var}(\hat \theta)}} \xrightarrow[n\rightarrow\infty]{(d)}\mathcal N(0,1)$,我们令右边的形式为Z,可以直接将W替换为Z,得到:

$$

\lim_{n\rightarrow\infty}\mathbf P_{\theta_0}[|W| > q_{\alpha/2}] = \lim_{n\rightarrow\infty}\mathbf P_{\theta_0}[|Z| > q_{\alpha/2}] = \alpha

$$

单侧检验:

单侧检验情况更复杂一些。我们希望控制犯Type 1错误的概率,也即是所有 $\theta \leq \theta_0$。

按照定义,可以进行以下变形:

$$

\lim_{n\rightarrow\infty}\mathbf P_{\theta}[W > q_{\alpha}] = \lim_{n\rightarrow\infty}\mathbf P_{\theta}[\frac{\hat \theta - \theta_0}{\sqrt{\widehat{var}(\hat\theta)}}>q_\alpha]

$$

注意到外层的概率是 $\theta$, 内层的W的表达式是 $\theta_0$。所以我们需要做一些变形将两者统一:

$$

\frac{\hat \theta - \theta_0}{\sqrt{\widehat{var}(\hat\theta)}} = \frac{\hat \theta - \theta}{\sqrt{\widehat{var}(\hat\theta)}} +\frac{\theta - \theta_0}{\sqrt{\widehat{var}(\hat\theta)}}

$$

当 $\theta \leq \theta_0$ 时,右边第二项<0。所以:

$$

\frac{\hat \theta - \theta_0}{\sqrt{\widehat{var}(\hat\theta)}} \leq \frac{\hat \theta - \theta}{\sqrt{\widehat{var}(\hat\theta)}}

$$

后续的步骤就是带入表达式,与双侧检验的做法一致。

具体的推导步骤见:

这两页PPT都是推导出了一个极限上界,即:

单侧检验时:

对所有 $\theta < \theta_0$, 极限不超过 $\alpha$。但这并不意味着在给定真值 $\theta$时,这个极限就等于 $\alpha$。具体的极限是多少,仍需带入W的具体公式进行计算。

⠀

双侧检验时:

第一问:

第一问:

第一问有两种解法。最简单的解法是假设n趋近无穷时, $\bar X_n 或 p$ 趋近于真值1/2。然后带入W统计量,有:

$$

W =\sqrt n *\frac{\hat p - p}{\sqrt{\hat p(1-\hat p)}} = \sqrt n*\frac{0.2-0.5}{\sqrt{0.2*0.8}} = -\sqrt n * C ,\ C是一个正整数。

$$

随n趋近正无穷,W趋近负无穷,永远小于 $q_\alpha$,所以概率为0。

标准的做法:

根据CLT和slutsky定理,首先定义 $Y:= \sqrt n*\frac{\bar X_n-0.2}{\sqrt{\bar X_n(1-\bar X_n)}} \rightarrow N(0,1)$

然后写出W统计量,将其变形为 $W = Y(中心化项) + 局部偏移项$。

$$

\begin{aligned} W &= \sqrt n*\frac{\bar X_n-0.5}{\sqrt{\bar X_n(1-\bar X_n)}} \\ &= \sqrt n*\frac{\bar X_n-0.2}{\sqrt{\bar X_n(1-\bar X_n)}} + \sqrt n*\frac{0.2-0.5}{\sqrt{\bar X_n(1-\bar X_n)}}\\ &= Y + \text{determinstic shift} \end{aligned}

$$

Y → N(0,1),第二项趋近负无穷,所以W > q/a的概率为0。

第二问:

第二问的解法与第一问基本一致。根据题目含义, $p$ 的真值为 $0.5 - \lambda/\sqrt n$。所以: $P_{0.5 - \lambda/\sqrt n}[\psi = 1]$ 的含义是:

在真参数值为 $0.5 - \lambda/\sqrt n$ 时,检验拒绝H0的概率。

这里的 $0.5 - \lambda/\sqrt n$ 是局部替代真值(来自局部替代理论)。

局部替代理论是想回答:当“几乎零差异”的时候,检验对这类情况有多敏感?

局部替代理论是想回答:当“几乎零差异”的时候,检验对这类情况有多敏感?

在局部替代下,W的极限分布不再是 $\mathcal N(0,1)$,而是:

$$

Z + \text{Shift}(\lambda)

$$

和第一问类似,将第二问的W统计量进行变形:

$$

\begin{aligned} Y &:= \sqrt n*\frac{\bar X_n-(0.5-\frac{\lambda}{\sqrt n})}{\sqrt{\bar X_n(1-\bar X_n)}} \\

W &= \sqrt n*\frac{\bar X_n-0.5}{\sqrt{\bar X_n(1-\bar X_n)}} \\ &= \sqrt n*\frac{\bar X_n-(0.5-\frac{\lambda}{\sqrt n})}{\sqrt{\bar X_n(1-\bar X_n)}} + \sqrt n*\frac{(0.5-\frac{\lambda}{\sqrt n})-0.5}{\sqrt{\bar X_n(1-\bar X_n)}} \\ &= Y + \frac{-{\lambda}}{\sqrt{\bar X_n(1-\bar X_n)}} \end{aligned}

$$

Y → N(0,1),第二项 $\sqrt{\bar X_n(1-\bar X_n)} \rightarrow 0.5$(根据局部替代理论也能看出来,随n增大, 扰动项趋近0,那么真值就趋近于0.5).

所以:

$$

\lim_{n\rightarrow\infty}\mathbf P_{0.5-\frac{\lambda}{\sqrt n}}[\psi = 1] = \mathbf P[Z > 1.645 + 2\lambda]

$$

这一节主要讲Wald test的P值计算。

⠀注意,在计算实际的p-value时,原分布可以是离散分布(例如伯努利);这时候计算的 $P(|W| > |W^{obs}|)$ 实际上就是计算 $P(W取值不等于观测值)$

在计算渐进p-value时,就是将W看成Z,只能是连续分布了。

Wald Test and the MLE

TBC,这道题挺复杂的。

TBC,这道题挺复杂的。

Basic Form of the Likelihood Ratio Test

Let $X_1,…,X_n \sim^{iid}\mathbf P_{\theta^*}$ , and consider the associated statistical model $(E,\{\mathbf P_\theta\}*{\theta\in\mathbb R^d} )$. Suppose that $\mathbf P*\theta$ is a discrete probability distribution with pmf given by $p_\theta$ .

In its most basic form, the likelihood ratio test can be used to decide between two hypotheses of the following form:

$$

H_0: \theta^* = \theta_0\\ H_1: \theta^* = \theta_1

$$

Recall the likelihood function:

$$

L_n : \mathbb R^n \times \mathbb R^d \rightarrow \mathbb R\\ (x_1,...,x_n;\theta) \mapsto \prod_{i=1}^np_\theta(x_i)

$$

The likelihood ratio test in this set-up is of the form

$$

\psi_C = \mathbf 1\left(\frac{L_n(x_1, ..., x_n;\theta_1)}{L_n(x_1, ..., x_n;\theta_0)}>C\right)

$$

where $C$ is a threshold to be specified.

简单来说,极大似然估计就是出现概率连乘。

例如丢一枚不均匀硬币,假设 $H_0:p^* = 0.25; H_1:p^* = 0.75$。如果只丢一次, $X_1 = 1$。

那么这个时候,两个假设下的似然函数分别是:

$$

L_1(1;0.25) = 0.25; L_1(1;0.75) = 0.75

$$

计算似然比等于 $3 > C=1$。所以拒绝原假设。

如果丢16次硬币,6次为HEAD, 10次为TAIL,那么两个假设下的似然函数分别是:

$$

\begin{align}

L_{16}(\mathbf X;0.25)=(1/4)^6(3/4)^{10}\\ L_{16}(\mathbf X;0.75)=(1/4)^{10}(3/4)^6

\end{align}

$$

这时候不用直接计算两个似然函数,而是直接比较其比值是否大于C。就能知道是否拒绝原假设了。

Wilks’s Theorem:

渐进服从自由度为d的卡方分布

d = 备择假设自由参数个数 - 原假设自由参数个数

Concept Check: The Constrained Maximum Likelihood Estimator

#Courses/MITx/18.6501x

At the end of this lecture, you will be able to do the following:

The $\chi ^2_d$ distribution with $d$ degrees of freedom is given by the distribution of

$$

Z_1^2+Z_2^2+...+Z^2_d,

$$

where $Z_1,…,Z_d \sim^{iid} \mathcal N(0,1)$.

PPT里提到的 $||Z||^2_2$,是欧几里得范数的平方。下标2代表欧几里得范数,上标2代表平方。

$$

||Z||_2 = \sqrt{Z_1^2+Z_2^2+...+Z_k^2}\\ ||Z||_2^2 = Z_1^2+Z_2^2+...+Z_k^2 = \chi^2_k

$$

卡方分布的基本性质:如果 $V\sim \chi^2_k$, 那么:

$$

\mathbb E[V] = k \\ \text{var}[V] = 2k

$$

不同自由度取值下,卡方分布的PDF:

不同自由度取值下,卡方分布的PDF:

假设 $X_1,…,X_n\sim^{iid}\mathcal N(0, \sigma^2)$,令:

$$

V_n = \frac{1}{n}\sum_{i=1}^nX^2_i

$$

如果想令: $a*V_n = \chi^2_k$, 求解a和自由度k。

首先根据卡方分布的基本形式,构造一个服从标准正态分布的随机变量 $Z$。(这里本身应该从单变量 $X_1$ 开始将其变形为服从 $\chi_1^2$ 的形式,但我这里直接简写了)

由: $Z = \frac{X}{\sigma} \sim \mathcal N(0,1)$, 有: $Z^2_n = \frac{X^2}{\sigma^2} \sim \chi_n^2$

再根据 $V_n$ 的形式,可以构造 $\frac{n}{\sigma^2}*V_n = Z^2_n \sim \chi_n^2$

回到第三节,我们继续求解之前遗留的表达式。

这里保留了原始的板书PPT,方便看推导过程。

清晰版:

清晰版:

同样的,保留原始的板书。T分布是一个标准正态分布Z和一个卡方分布除以其自由度的比值。

$$

t_k = \frac{Z}{\sqrt{V/k}}

$$

随着自由度 $k$ 变为无穷大, $V/k = Z_1^2+Z_2^2+…+Z_k^2/k$ 根据大数法则,p/a.s收敛于 $E[Z_1^2]= 1$, t分布收敛于正态分布。

在使用T检验在小样本上是,有一个假设前提是X iid服从正态分布,期望与方差是未知的。

保留第二张PPT的备注:

#Courses/MITx/18.6501x

At the end of this lecture, you will be able to do the following:

TBC

这道题挺有意思的

多重检验时会出现什么问题?

即使每个试验都严格遵守了T-test,但是每个独立实验的假阳性率加总到一起也是一个巨大的数字,会导致我们做出假阳性的结果。

In the setting of multiple testing, we can control the two following metrics for false significance:

⠀Family-wise error rate (FWER)

For a series of tests in which the $i$ th test uses a null hypothesis $H_0^i$ , let the total number of each type of outcome be as follows:

Then the family-wise error rate (FWER) is the probability of making at least one false discovery, or type I error;

$$

\text{FWER} = \mathbf P(V\geq 1).

$$

where $V$ is the total number of type I errors as in the table above, i.e., $V=\sum_{i=1}^{m_0}\Psi_i$ where $\{\Psi\}$ is the set of $m_0$ tests for which $H_0$ is true.

In scenarios in which any false claims of discovery may lead to serious consequences, such as for drug approval, we want to control $\text{FWER}$.

$\text{FWER}$ with no corrections

Recall from the lecture the paired test in which treatment effects are measured on 100 variables for 1000 people, and the treatment itself is a placebo (of being given water). If we perform $m$ independent tests each at significant level $\alpha$, then the $\text{FWER}$ is

$$

\text{FWER} = \mathbf P(V\geq1) = 1- \mathbf P(V=0) = 1-(1-\alpha)^m \approx 1 \quad \text{for large}\ m.

$$

In other words, if we set the significance level of each test without taking into account the large number of tests performed, it is highly likely that the series of tests will lead to at least one false discovery. This often leads to puzzling claims such as water has treatment effect on important health parameters, or eating pizza reduces the risk of cancer.

False Discovery Rate (FDR)

Sometimes, controlling $\text{FWER}$ (the probability of making one or more false discoveries) may be too strict for any discovery to be reported. Instead, we can then control the expected proportion of false discoveries among all discoveries made, the false discovery rate (FDR).

Recall $N_1$ is the total number of discoveries made (the total number of null hypotheses rejected), and $V$ is the number of false discoveries (the number of null hypotheses that were falsely rejected). Hence $V \leq N_1$ and $V/N_1$ is a ratio that is always between 0 and 1. If no null hypotheses were rejected, i.e. if $N_1 = 0$, we define the ratio $V/N_1$ to be zero to avoid a division by zero.

The false discovery rate (FDR) is

$$

\text{FDR} = \mathbb E\left[\frac{V}{N_1}\right]

$$

FDR versus FWER (TBC)

Compared to $\text{FWER}$, $\text{FDR}$ has higher power . Put another way, $\text{FWER}$ is stricter than $\text{FDR}$.

Let us examine this by considering the trivial scenario where all null hypotheses are true. In this case, any rejected null hypothesis must also be falsely rejected, hence . If any null hypothesis was rejected, then , or if none was rejected, then .

Recall the is the probability that one or more null hypotheses were falsely rejected. In this scenario, this is the same as the probability that one or more null hypotheses were rejected, since any rejection is a false rejection. We can see now that if one or more null hypotheses were rejected, then , and so

Now consider the general case when some null hypotheses may be false. This time, when , we only know that . Define an indicator varible which takes value when . Then

有很多Lecture来不及写进来了。

Benjamini-Hochberg Correction

The Benjamini-Hochberg method guarantees $\text{FDR} < \alpha$ for a series of $m$ independent tests. The procedure is as follows:

$$

p^{(k)} \leq \frac{k}{m}\alpha

$$

For example, the table below shows the $p$-values from 5 hypothesis tests in an experiment in increasing order. We compute the adjusted p-value and compare it with significance threshold of 5%, to decide whether to reject the null hypothesis:

#Courses/MITx/18.6501x

At the end of this lecture, you will be able to do the following:

⠀在本讲座结束时,您将能够做到以下几点:

这道题做错了,需要复习

In the topic goodness of fit testing, we want to decide whether our data can be modeled by a specific type of distribution (e.g., uniform, Gaussian, Poisson). In practice, a useful tool for making such a decision is to use a histogram of the data set.

A histogram for a sample data set is shown below. The -axis, which represents the sample space, is divided into the intervals for all . The bar over the interval represents how many data points took values in that interval.

按黑板上的板书,假设x轴是p1, y轴是p2, 那么 $\Delta k(k=2)$ 就是图中的x+y=1这条线。

更一般的表述: $\Delta_k$ 是所有可能的PMF的集合。 $\mathbb P_p$ 是某个特定PMF p的随机变量的分布。

The Probability Simplex in $K$ Dimensions (TBD):

The probability simplex in , denoted by , is the set of all vectors (note that we are using subscripts for vector indices for simplicity) such that

where denotes the vector . Equivalently, in more familiar notation,

我们尝试写出似然函数,那么首先需要写出PMF of X。

multinomial是binomial的扩展形式。所以这里用到了一个小trick,目的是把iff X = a_j的PMF变形为一个连乘形式,所以用到了指示函数。

然后对n个样本的概率连乘,就写出了似然函数。

The Multinomial Distribution with $K$ modalities (or equivalently $K$ possible outcomes in a trial) is a generalization of the binomial distribution. It models the probability of counts of the $K$ possible outcomes of the experiment in $n'$ i.i.d. trials of the experiment.

It is parameterized by the parameters $n', p_1, p_2, …, p_K$ where

Let and note that .

The multinomial distribution can be represented by a random vector to represent the number of instances of the outcome . Note that . The multinomial pmf for all such that , , and is given by

Categorial (Generalized Bernoulli) Distribution and its Likelihood

The multinomial distribution, when specialized to $n' = 1$ for any $K$ gives the categorical distribution . When $K=2$ and the two outcomes are 0 and 1 the categorical distribution is the Bernoulli distribution, and for any $K \ge 2$ the categorical distribution is also known as the generalized Bernoulli distribution .

The categorical distribution, therefore, models the probability of counts of the possible outcomes of a discrete experiment in a single trial. Since the total count is equal to 1 (only one trial), we can use a random variable to represent the outcome of the trial. This means the sample space of a categorical random variable is

上一节我们已经写出了似然函数,那么现在需要求解MLE。

首先一个最容易犯的错误就是将其取log后求偏导,这时候算出来的p_j 为无穷大。

→ 为什么?因为没有考虑到一个限制条件 sum p_j = 1。所以我们要将最后一项变形为 1 - sum^K-1 p_j。

现在求解出来了偏导为0时,关于p_j的一个表达式。

我们现在有K-1个未知数,K-1个方程,但目前还不能单独对每个p_j求解,因为所有方程都依赖所有的变量。

我们将每一个偏导方程都列出来,可以很轻易发现,等式右边都是相等的。

我们令方程右边都等于gamma, 可以发现 p_j = N_j/gamma。

现在求解gamma: 因为sum p_j = 1, 意味着sum N_j/gamma = 1. 又因为sum N_j = n,所以gamma = n.

当然,如果要正式求解,可以利用拉格朗日算子,但这里的内容简单,没必要。

TBD

这道题里既可以用上面PPT推导出的结论做,也可以用拉格朗日算子,但我不太清楚怎么应用的,后面复习

这道题完整理论理解需要用到线性代数知识,需要复习

高斯分布的退化

$\sqrt n(\hat p-p^0)^T*\mathbb 1$ 代表两个向量求内积。(1是n维全1向量),结果是向量的内积之和。

等于 $\sqrt n\sum_{j=1}^K(\hat p_j-p_j^0) = 0 \xrightarrow[n\rightarrow\infty]{}0.$ (p_j的和为1)

这道题主要是定义比较复杂。

首先抓住问题中的关键假设:MLE渐进正态性,有:这是MLE渐进正态性的标准通式。

$$

\sqrt n(\hat\theta^{MLE}_n-\theta^0=*) \xrightarrow[]{d}\mathcal N(0, I(\theta^*)^{-1})

$$

在原假设H0下, $\theta^* = \theta^0$, 带入后,MLE的误差 $\hat \theta_n - \theta^0$ 服从正态分布,协方差 $\Sigma$ 是Fisher信息矩阵的逆。

接下来看构造的统计量(结合这一节的PPT与课前练习),将他转变为一个向量二次型的形式:

$$

T_n = n\sum_{i=1}^d\frac{(\theta_i^0 - \hat \theta_i)^2}{t_i} \\ = (\sqrt n(\hat \theta_n - \theta^0)^T·I(\theta^0)·(\sqrt n(\hat \theta_n - \theta^0)

$$

这是一个标准化的平方误差和,类似一个广义形式的Wald统计量。

T_n是一个均值为0、协方差为 $I^{-1}$ 的正态向量经过 $I$ 的二次型。

这么写的目的是:

1. 便于分析渐进分布:在H0下, $\sqrt n(\hat \theta - \theta^0) \sim N(0, I(\theta^0)^{-1})$

2. 将标准正态分布左乘一个矩阵再右乘其转置(标准正态的二次型),正好是卡方分布的定义。?

⠀

接下来做渐进行为分析:

设 $Z_n:= \sqrt n(\hat \theta - \theta^0) \xrightarrow{d} \mathcal N(0, I(\theta^0)^{-1})$。那么,有:

$T_n = Z_n^T \Sigma^{-1} Z_n \xrightarrow{d} \chi_d^2$, 这里的 $\Sigma = I^{-1}$。

这里用到了定义(虽然Z_n不是标准正态分布,但左右乘上了I(theta),就起到了标准化的作用。

[!IMPORTANT]